Facebookは、世界最大のソーシャルネットワーク上で見つかった潜在的ダメージに関して、ささやかなダメージコントロールを実施する取り組みの中で、ユーザーから送信された報告を同社がどのように取り扱うかを明らかにする指針を発表した。

Facebookは最初に、送信される報告に対し、「Facebookチームがいつでも確実に報告に対処できるよう」、世界中のオフィスに散在する多数の従業員が毎日24時間対応する、と説明している。

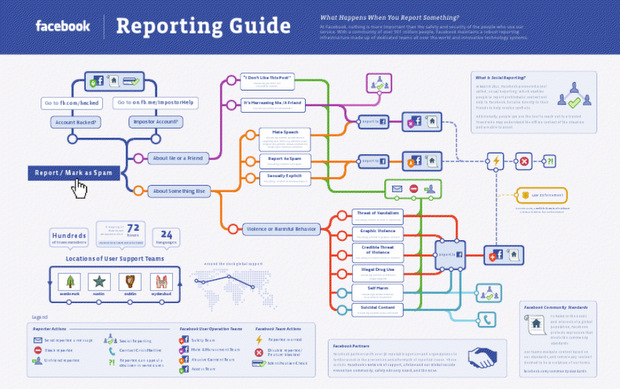

それだけでなく、これらの報告の対処方法を示すフローチャートも公開された。

報告対象がスパムか、さらに悪質なものかに応じて、FacebookのUser Operations部門は専門の4チームに分割され、特定の報告タイプ(安全性、憎悪や嫌がらせ、アクセス問題、不正コンテンツ)について精査する。

その先は、数通りの対応が想定されている。報告されたコンテンツが無価値でFacebookのポリシーを侵害していると判断された場合、そのコンテンツは削除され、投稿したユーザーは警告を受ける。

だが、コンテンツがきわめて悪質な場合(露骨な写真、なりすましアカウント、不快なコンテンツなど)、報告は一気に法執行機関へと送られる可能性がある。検索やソーシャルネットワーキングを手がける主要企業の大半は、すでにこうした指針を事業の基盤として整えているため、これは決して異例の措置というわけではない。だが、Facebookは機会を利用して、すべてのユーザーが理解可能と考えられるシンプルなフローチャートでこの指針を公開することにより、透明性を高めようとしている。

Facebookには、この指針を公開する動機がさらにいくつかある。まずFacebookは、ユーザーに対し、どのコンテンツを有害だとして同社に報告するかについて、気まぐれになりすぎないよう知らせたいはずだ。だが同時に、Facebookがユーザーからの報告を真摯に受け止めていることを示して、9億人以上の登録ユーザーを安心させる狙いもある。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する