筆者は、米カリフォルニア州クパチーノにあるApple本社の奥まった場所にある、金網でできた床の上に立っていた。その「床」は、4フィート(約1.2m)の高さの吸音くさびで覆われた穴の上に吊り上げられたものだ。その部屋の壁と天井も同じように、反響音をほとんど吸収してしまう、大きなくさび形状の多孔質材料で覆われていた。そこで手を鳴らしても、両手がぶつかったくぐもった音が聞こえるだけだった。その部屋はあまりにも静かで、感覚遮断に興味がある人なら、この奇妙な部屋に安心感を覚えたかもしれない。

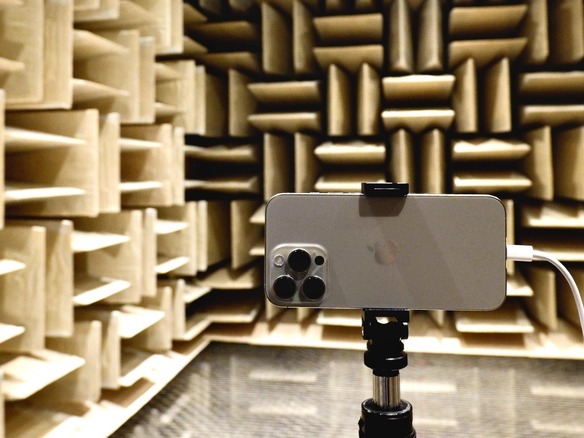

iPhone 16 Proのマイクのテストに使用されたAppleの無響室。

iPhone 16 Proのマイクのテストに使用されたAppleの無響室。これは長波無響室と呼ばれる、「iPhone 16」のテストと調整に使用されている部屋だ。筆者がこの部屋の内部を見たのは、2024年12月の初めに、AppleがiPhoneの音声や動画撮影の機能のテストと調整に使用しているいくつかの秘密ラボを見学させてもらうという貴重な機会を得たときのことだった。

iPhoneの高品質な動画を撮影する能力は、長年の間高く評価されてきた。Steven Spielberg氏やZach Snyder氏、Steven Soderbergh氏、Rian Johnson氏などの著名な映画監督も、iPhoneだけを使って長編映画やミュージックビデオ、短編映画などを撮影している。

しかし、サムスンをはじめとする競合他社が追い上げてきたことで、動画撮影に関するiPhoneの優位性は脅かされつつある。実際、「Galaxy S24 Ultra」で撮影した4K動画は、画質の面でも機能の多彩さの面でも素晴らしいものだったし、Googleも2023年に、「Pixel 8 Pro」で撮影した動画をクラウド上で処理することで、低照度で撮影された映像の品質も改善できる「動画ブースト」機能をリリースしている。

しかしこれらはすべて、iPhone 16 Proが発売される前の話だ。筆者はレビュー記事で、iPhone 16 Proで新たに搭載されたスローモーション撮影機能や、優れたスピーカーや、カメラの改善などを高く評価したが、同じように考えている人は他にもたくさんいる。

2024年8月に実施された米CNETの調査では、回答者の38%が、新しいスマートフォンを購入する一番の動機はカメラだと回答している。Appleは、ハリウッドの映画監督だけでなく、多くの人がスマートフォンで動画を撮影するようになったことを受けて、画像品質とダイナミックレンジの両面でスローモーションを普通の動画と同じレベルで撮影できるようにし、iPhoneの動画撮影能力を大きく高めた。さらに、ユーザーが撮影した動画の音声品質を調整できる新機能である「オーディオミックス」を導入して、空間オーディオを扱う能力を改善した。この機能を使えば、「写真」アプリのスライダーを動かすだけで、被写体がピンマイクを付けていたかのような音や、あるいはプロ向けのスタジオで録音したかのような音を再現することができる。

AppleがiPhone 16シリーズのカメラとマイクや、オーディオミックスなどの独自の新機能の開発につぎ込んだ時間やテスト、調整の手間は、驚くべきものだ。

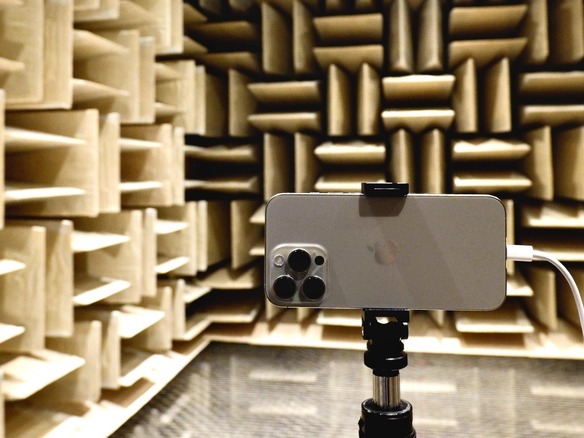

無響室の壁の様子。

無響室の壁の様子。iPhone開発の舞台裏を巡るツアーで最初に訪れたのが、周囲すべてが多孔質材料で覆われたこの無響室だった。この部屋の静けさと比べれば、図書館が地下鉄の駅のように騒がしく感じてしまうほどだ。この部屋は、iPhone 16のマイクをテストしてその特性を評価するために使用されたもので、その結果がオーディオ関連の開発に生かされている。Appleは、ほかのスマートフォンメーカーと同じように、ポケットに入る大きさでありながら、原音に忠実なサウンドを捉えることができ、人間が耳にした通りの音で再生できるデバイスを作るという課題に挑戦している。

見学ツアー中、Appleの音響エンジニアリング担当シニアディレクターであるRuchir Dave氏は、「iPhoneは世の中に広く普及している録音デバイスであり、使われる環境も多岐にわたっている。私たちは、ユーザーが記録に残したいと思う記憶を、本当の姿のまま捉えられるようにしたいと考えている」と語った。

iPhone 16には4つのマイクが搭載されている。しかし、ニュースキャスターが着けているピンマイクのような通常のマイクと比べると、iPhoneのマイクは小さい。そのため、もっと大きなマイクや、シャツに取り付けるピンマイクよりも高品質な音を捉えるためには、iPhone 16のそれぞれのマイクが実際に拾っている音を調べることから始まる、巧妙なエンジニアリングを行う必要があった。

iPhone 16 Proには、4つのマイクを搭載している(金色の四角がマイクの位置)。

iPhone 16 Proには、4つのマイクを搭載している(金色の四角がマイクの位置)。「私たちは品質と実用性の両方を追求した。その一環として、スマートフォンとして最高の音響性能を実現するための、まったく新しいマイクコンポーネントを開発した」とDave氏は述べた。「それと同時に、さまざまな音を捉え、それを好きなように編集してクリエイティブな自由を発揮できる柔軟性をユーザーに提供する、オーディオミックスなどの機能を開発した」

そのために必要だったのが、チャイムテストを行うための無響室だ。その無響室には、金網の床の下から天井にまで至る円弧状のパイプが設置されており、そのパイプに20台以上のスピーカーが取り付けられていた。テストでは、それらのスピーカーから一連のチャイム音が鳴り、エンジニアがiPhone 16 Proのマイクが拾っている音を測定する。それが終わると、回転式の台座の上にあるスタンドに取り付けられたiPhoneが時計回りに少しだけ回転し、再びチャイム音が鳴る。この作業をiPhoneが一周回るまで続けるのだ。

筆者が訪れた無響室は、壁や天井や、金網でできた床の下がすべて吸音くさびで覆われていた。この部屋は、iPhone 16のマイクをテストするために使われたものだ。

筆者が訪れた無響室は、壁や天井や、金網でできた床の下がすべて吸音くさびで覆われていた。この部屋は、iPhone 16のマイクをテストするために使われたものだ。これによって、その無響室で録音されたデータから、各マイクの全周囲のサウンドプロファイルを作成することができる。Appleはこのプロファイル情報を、空間オーディオの基礎や、風によるノイズを低減したり、iPhoneで録音した音声を他の種類のマイク(ピンマイクやボイスオーバーの録音に使用するスタジオマイク)で録音した音のように加工するためソフトウェアなどに使用している。

「私たちは、このオーディオミックスの機能で、ピンマイクを使ったかのような録音ができるようにしたいと思っている」とDave氏は説明した。「音声チューニングのための処理と併せて機械学習アルゴリズムを使用することで、ピンマイクに近い特性の音を生み出すことができる」

筆者が実際の取材で専用のカメラを使ってインタビューを記録する場合には、相手に無線のピンマイクを着けてもらい、口に近い位置で録音するようにしている。これは、取材相手の声をできる限り拾うためだ。しかし、iPhoneで動画を撮影する場合、マイクはiPhoneの場所にあり、それ以上物理的に近づけることはできない。Dave氏のチームが解決しようとしているのは、そういう状況の問題だ。

AppleのiPhone製品マーケティング担当ディレクターを務めるFrancesca Sweet氏は、「私たちはこの技術の開発に何年も費やしてきており、私たちが今持っている機械学習に関する技術の多くは、長年にわたって培ってきた経験と専門知識に基づいている」と述べた。

その成果は実を結んでいる。筆者は、iPhone 16 Proをテストした際に、友人が話しているところを撮影した動画にオーディオミックスを使ってみたのだが、驚くほどうまく機能した。もちろん、オーディオミックスは万能ではない。しかし、筆者がシカゴでiPhone 5を使って低予算のCMや短編映画を撮影し、それを別のオーディオレコーダーで録音した別の音声と同期させなければならなかったときのことを振り返ると、オーディオミックスのような機能があれば、時間とストレスを大いに減らしてくれただろうと思える。

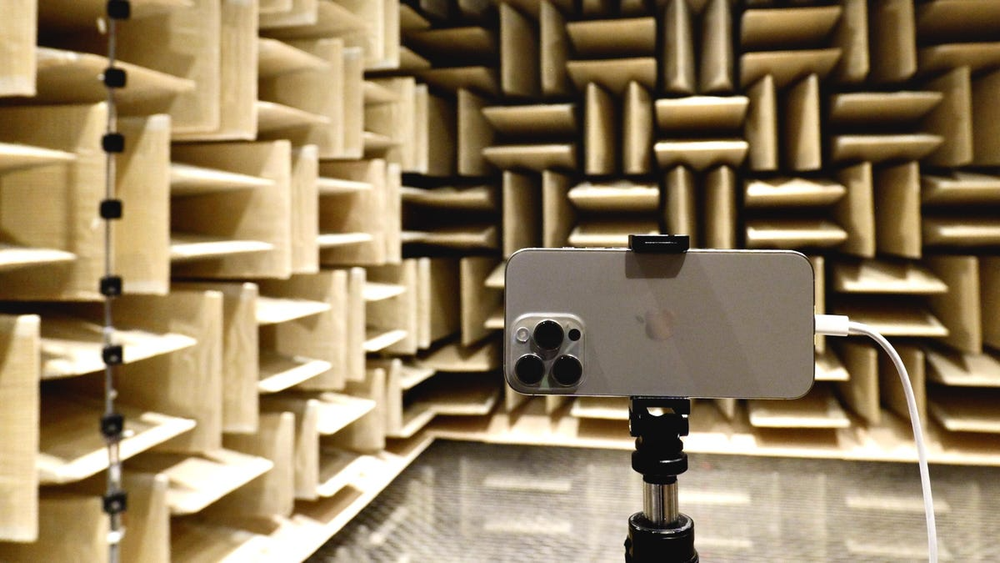

Appleは、さまざまな人を対象にオーディオの比較テストを行い、そのフィードバックをiPhone 16でのオーディオの録音や再生のチューニングに反映させている。

Appleは、さまざまな人を対象にオーディオの比較テストを行い、そのフィードバックをiPhone 16でのオーディオの録音や再生のチューニングに反映させている。テストはそれで終わりではなかった。見学ツアーで次に訪れたのは、iPhoneのオーディオをチューニングするための再生音源の比較テストが行われる場所だった。無響室から迷路のような通路を歩いていくと、小さなスタジオがいくつかある廊下に出た。各スタジオは防音になっていて、中には机と椅子があり、その上に「Mac Studio」、「Studio Display」、「AirPods Max」が置かれていた。

Appleは、優れた耳を持つ1人のプロフェッショナルにiPhoneのオーディオをチューニングさせるのではなく、たくさんのテスターに聞き取りテストを行わせ、その結果をiPhoneで再生される音声の調整に反映させている。その部屋を訪れた時、筆者はテスターの1人となってテストの一部を体験させてもらうことができた。

「優れた耳を持つRuchir(Dave氏)だけがそこに座って、どんな音にすべきかを指示しているわけではない」と、Sweet氏は強調した。「これは、オーディオミックスを利用するすべての人にその良さを感じてもらい、楽しんでもらいたいと思っているからだ」

筆者はデスクに座ってAirPods Maxを着け、2種類の音声トラックが用意されているビデオクリップを再生した。オーディオの良し悪しを評価できるように、2つのトラックは自由に切り替えることができた。テストはそれだけのシンプルなものだった。最初の動画は大都市の歩道にいる人たちのグループを映したもので、2つ目は、雨の中を傘を差しながら歩いている男性の自撮り動画だった。自撮り動画の片方の音声トラックでは、風切り音が耳に付いた。しかし、もう一方のトラックではそれがほとんど聞こえなかった。

Appleは、このような比較テストを、眼科医が視力検査で2種類のレンズのうちどちらがよく見えるかを選ばせるのと同じような形で使っている。これは、比較対象がなければ、録音の品質を評価するのが難しいためだ。知覚テストの結果は、オーディオミックスを含むiPhone 16 Proのさまざまなオーディオ関連の機能に反映されている。

iPhone 16 Proの「写真」アプリには、撮影した動画のオーディオ品質を変更できる「オーディオミックス」と呼ばれる機能が搭載されている。

iPhone 16 Proの「写真」アプリには、撮影した動画のオーディオ品質を変更できる「オーディオミックス」と呼ばれる機能が搭載されている。「オーディオミックスを開発した背景には、iPhoneがありとあらゆるシナリオ、サウンドスケープ、環境で使われているということがある」とDave氏は言う。「私たちは、ユーザーに『このサウンドはこんな風にキャプチャーされるべきだ』と押しつけて、そのあり方をハードコーディングするのではなく、シナリオに応じてユーザーが求めている形でサウンドをキャプチャーできる柔軟性を提供したいと思っている」

Dave氏は、当たり前の話だが、動画マニア(これは筆者の考えた言葉で、同氏がこういう表現を使ったわけではない)でなくても、iPhoneで素晴らしいオーディオの動画を撮影することは可能だと付け加えた。

「私たちは、すべてのユーザーが動画を編集し、スライダーを動かすと思っているわけではない」とDave氏は述べた。「ユーザーの撮り方が私たちの想定と一致していれば、そのままでも素晴らしいサウンドが得られるはずだ。そして、それでもやはり好みに合わせて音を変えたいという人は、自由に変えられるようになっている」

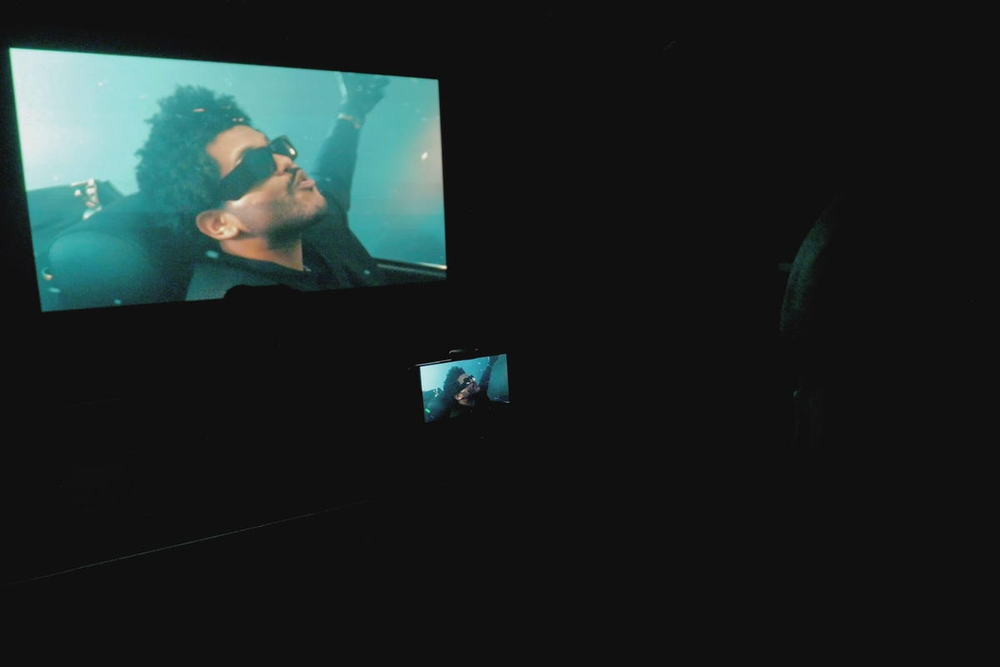

Appleの動画検証ラボに入ると、シアターのスクリーンにAppleのロゴだけが映っていた。

Appleの動画検証ラボに入ると、シアターのスクリーンにAppleのロゴだけが映っていた。最後に訪れたのは動画を検証するためのラボだった。無響室がノイズや刺激を最小限に抑えるためのものだとすれば、映画館サイズのスクリーンを備えたこのラボは、その対極にあると言っていい。シアターの細部や調整室までは見られなかったのだが、自分がiPhoneで撮影した動画を見るための、プライベートなDolby Atmosシアターだと言えば雰囲気は理解してもらえるだろう。

Appleの動画エンジニアリング担当ディレクターであるSean Yang氏の説明によれば、「暗い部屋や、オフィスや、日光の下などで動画を再生したときにも、シアターで映像を見ているのと同じ感覚の体験が得られるように、このシアターを使って動画再生体験をチューニングしている」という。

同社は工場ですべてのiPhoneのディスプレイにキャリブレーション作業を行い、色が正確か、輝度が均一か、輝度のピークが仕様と一致しているかを確認している。しかしYang氏のチームは、それとは別に、さまざまな場所で再生した動画の見え方に取り組んでいる。スマートフォンの画面は、テレビやモニターとは違って、画面が見づらい屋外(これには直射日光を浴びる環境も含まれる)で視聴されるケースにも対応しなくてはならない。iPhoneは、環境光センサーで検知した周囲の明るさに応じて動画の再生方法を調整している。

Appleは、オーディオのチューニングに知覚テストを使ったように、iPhoneで動画再生のあり方を1人で決めるのではなく、多くの人からフィードバックを集めて決めているという。

「私たちは、Apple社内の専門家のグループにこの動画を見せている。意見に違いがあれば、その専門家たちを集めて議論する」とYang氏は説明した。「トレードオフが生じることも多いため、社内の多くの専門家に相談して、どんな場所で再生しても最高の品質で動画を見られるようにした」

筆者は、動画検証シアターのスクリーンとiPhone 16 Proで、さまざまな動画クリップを比較した。

筆者は、動画検証シアターのスクリーンとiPhone 16 Proで、さまざまな動画クリップを比較した。筆者はシアターのスクリーンで、iPhone 16 Proの画面で再生される動画がどんな風に見えるかを模倣するデモを見せてもらった。そのデモは、映画やアニメのクリップや、iPhone 16 Proで撮影された動画のクリップが入り交じったものだった。その中には、iPhone 16 Proに追加された新機能の中でも筆者のお気に入りのひとつである、4K 120fpsのスローモーション動画を再生したクリップも含まれていた。

「4K 120fpsの映像のデータは膨大な量になる。考えてみてもらえば分かるが、これは1秒間に10億ピクセルのデータ量に相当する」とYang氏は述べた。

筆者は自分でも計算してみた。4K動画の1フレームは829万4400ピクセル(3840×2160ピクセル)であり、1秒あたり120フレームだとすれば、そのピクセル数は毎秒9億9532万8000ピクセルになる。4K 120fpsを実現するためにiPhone 16 Proが処理しなければならないデータの量は驚くべきものだし、その結果完成したスローモーション動画の画質や、ダイナミックレンジの素晴らしさもそれに劣らず驚嘆すべきものだ。

iPhone 16 Proで撮影したスローモーション動画から抜き取ったスチル画像。

iPhone 16 Proで撮影したスローモーション動画から抜き取ったスチル画像。Sweet氏は、「重要なのは、ごまかしがまったく利かないということだ。毎秒120フレームで撮影し、それを半分の速度や4分の1の速度で再生すると、すべてのフレームを細部まではっきりと見ることができる。そのため、アーティファクト(画像処理の過程で生じたノイズ)のようなものが残っていれば、見ている人に伝わってしまう」と付け加えた。

もちろん、スローモーションをまったく撮影しない人であっても、動画を再生するたびにYang氏のチームが行ってきた作業の恩恵を受けることができる。それが「スター・ウォーズ:スケルトン・クルー」であっても、古くからの友人と思い出を語り合いながら乾杯した時の自撮り動画であっても同じだ。

これは、動画検証テストの様子を筆者の支店から写した写真だ。左側はiPhone 16 Pro、背景に写っているのがシアターのスクリーンの映像。

これは、動画検証テストの様子を筆者の支店から写した写真だ。左側はiPhone 16 Pro、背景に写っているのがシアターのスクリーンの映像。筆者は、見学したラボやエンジニアたちの話を振り返りながら、その日の最後にSweet氏が語った言葉のことを思い返した。

Sweet氏は、「私たちは、オーディオや動画を操作できるこうした非常に強力なツールを、シームレスかつ非常に利用しやすい形で提供するよう努力している」と述べていた。「しかし実は、それをシンプルにするためにも、膨大な量のエンジニアリング作業がつぎ込まれている」

Appleはオーディオミックスや4Kスローモーションなどの機能を実現するためにエンジニアが膨大な労力と時間を費やしたことを見せてくれたが、それだけではなく、それらの技術を簡単かつ一貫した形で使えるようにするためにも労力を費やしている。

次にiPhoneを使って短編映画や、リビングルームで遊ぶ子供たちを撮影するときには、ぜひそのことにも想像力を働かせてみてほしい。

この記事は海外Ziff Davis発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する