Googleは米国時間12月5日、自動で生成された字幕の表現をよりリアルなものにする新機能「Expressive Captions」を米国で提供開始した。この機能では、動画やライブ配信で誰かが話している内容だけでなく、その人が「どのように」話しているかも伝えることができる。

提供:Google

提供:Google

例えば、誰かが興奮して「HAPPY BIRTHDAY!(誕生日おめでとう!)」と言うと、字幕はすべて大文字で表示される。拍手や音楽など周囲の音も描写され、その場の様子がより鮮明に伝わる。ため息やうめき声、息をのむような音なども文字に起こして表現する。

この新機能は、動画、電話、音声メッセージなどにリアルタイムで字幕を自動生成する「Live Caption(自動字幕起こし)」の一部だ。この機能は「Android」OSに組み込まれており、スマートフォンのアプリ全体で使えるため、ソーシャルメディアのライブ配信や動画メッセージなど、ほとんどの視聴コンテンツに対応する。字幕はデバイス上で生成されるため、機内モードでも、インターネット接続がなくても利用できる。

提供:Google/Jeffrey Hazelwood/CNET

提供:Google/Jeffrey Hazelwood/CNET

従来、字幕は耳が不自由な人がテレビ番組の内容を理解するのに使ってきた。しかし近年では、例えば地下鉄で音を出さずに動画を視聴したり、映画やテレビ番組の内容をよりよく理解したりするために、さまざまな層の人々が利用している。オンライン語学学習サイトPreplyによると、米国ではZ世代ユーザーの70%が頻繁に字幕付きでテレビを見ているという。一方、ライブ配信やSNSコンテンツ、友人や家族からの動画には、キャプションがあらかじめ含まれていないことが多い。

Expressive Captionsは、米国で5日から提供される。Android 14以降を搭載し、自動字幕起こしに対応するデバイスが対象で、英語で利用できる。

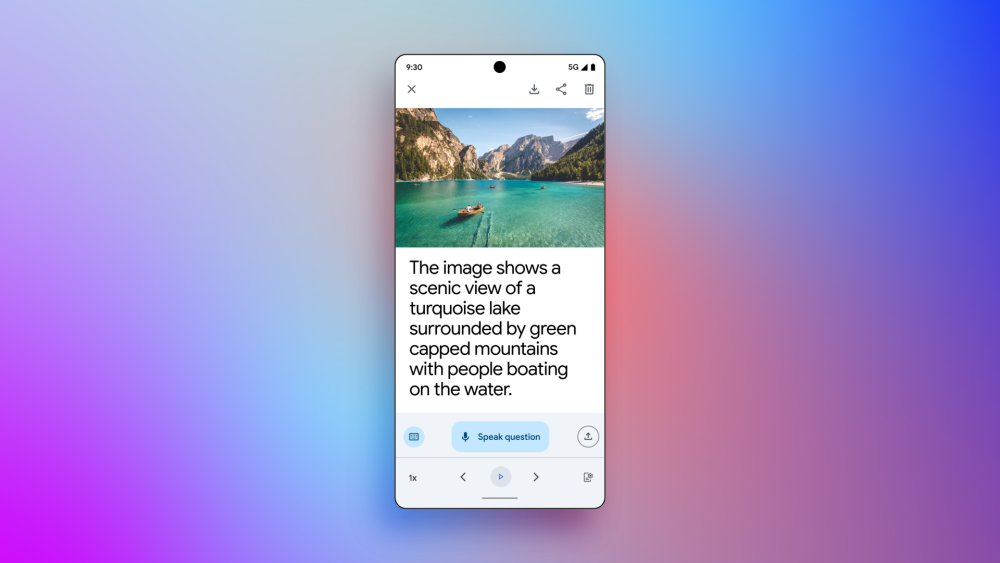

Googleはこのほか、目の不自由なユーザーが物体を識別したり、周囲の情報を得たりするのに役立つアプリ「Lookout」もアップデートした。画像に関する追加の質問ができるQ&AモードにAIモデル「Gemini」を採用し、回答を強化した。

提供:Google/Jeffrey Hazelwood/CNET

提供:Google/Jeffrey Hazelwood/CNET

また、同社はAndroidのGeminiに拡張機能を追加し、ユーティリティ、Spotify、メッセージ、電話などのアプリにGeminiから簡単にアクセスできるようにした。

「Pixel」デバイスには、Geminiに関心や好みを記憶させる機能なども追加されている。

Android’s Expressive Captions uses AI to bring emotion to captions

高コスパなシャオミのPD対応モバイルバッテリー(価格をAmazonでチェック)

この記事は海外Ziff Davis発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する