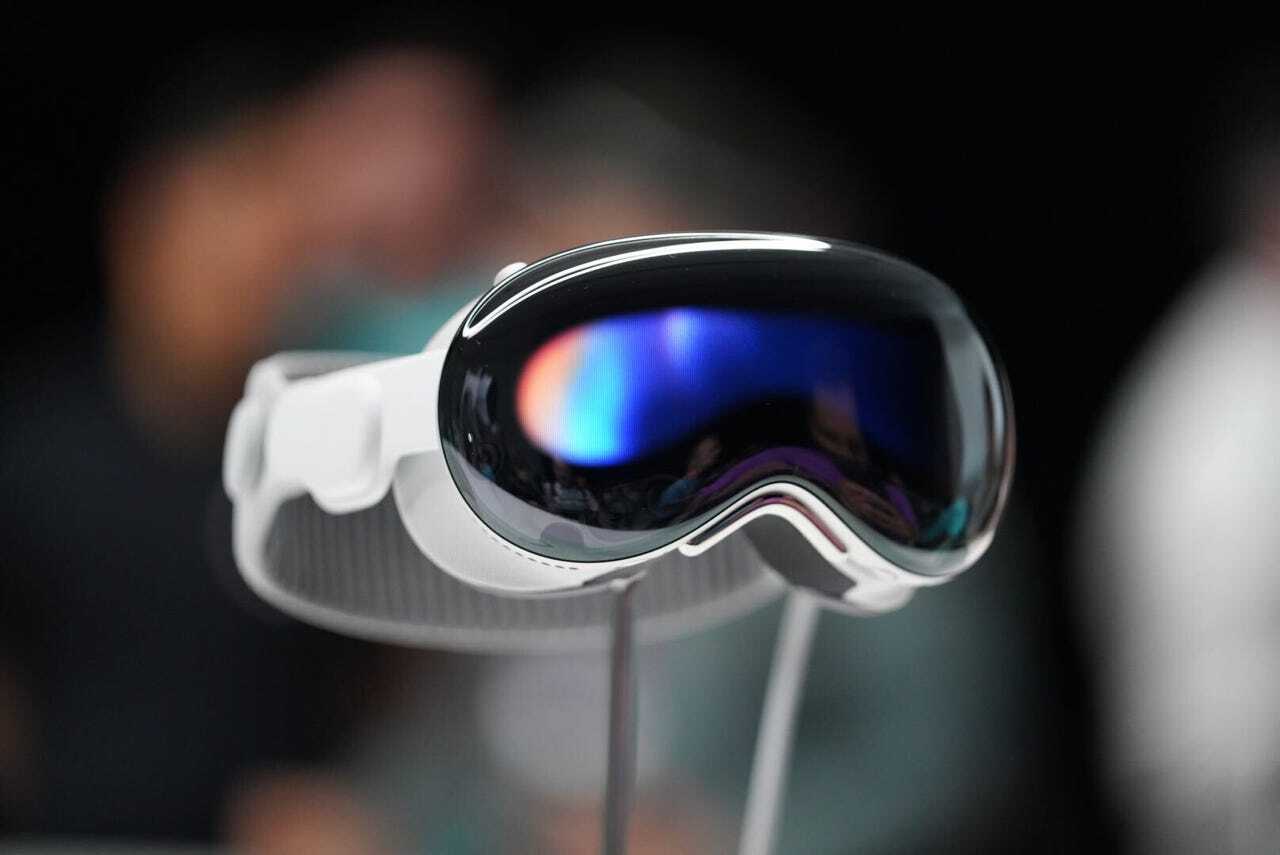

Appleの最新製品「Vision Pro」のニュースをもう目にしただろうか。この複合現実(MR)ヘッドセットは、視線や手の動きによるナビゲーションやインタラクションといった機能を搭載しており、特殊な3Dカメラによって3次元の画像や動画を撮影してヘッドセット内で視聴できる上、「FaceTime」のビデオ通話で使えるユーザーのアバターも作ってくれる。

このヘッドセットには大量のテクノロジーが搭載されている。同社独自のmicro-OLEDテクノロジーを採用したディスプレイによって2300万以上のピクセル表示が可能になっている点は言うまでもなく、Appleの「M2」プロセッサーと、新たに開発された「R1」プロセッサーに加え、数多くのカメラやセンサー、マイクが搭載されている。こうした数々のテクノロジーが採用されている点と、第1世代のデバイスであるという点が、3499ドル(約49万円)という価格の一因となっている。いや正確に言えば、3499ドルは開始価格だ。

Appleが、より多くのストレージを搭載したり、追加のバッテリーパックを搭載した複数のモデルを販売するかどうかは分からないが、多くの人々にとってVision Proの開始価格を引き上げる要素が少なくとも1つあることは分かっている。それは視力矯正用のレンズだ。プレスリリースの注釈部分、そしてAppleのウェブサイト内にあるVision Proのページには、こうしたレンズが別売りになると記されている。

その通りだ。筆者のようにメガネを必要としている人間がこのヘッドセットを使用するには、Vision Pro向けに作られたZEISS製の専用レンズを購入する必要がある。

Appleが「オプティカルインサート」と呼ぶこのレンズは、ヘッドセットの内側に磁力で固定されるようになっている。

こういったオプティカルインサートは、視線追跡用のセンサーや、ヘッドセットのロックを解除する虹彩センサーと連携するとともに、画質を劣化させたり画像をひずませることなく機能する必要がある。

このオプティカルインサートもヘッドセットと同様、安価なものにはならないだろう。筆者はオプティカルインサートに関する詳細をAppleに問い合わせているが、今のところ回答はない。筆者の想像になるが、Vision Proが実際に顧客に向けて出荷されるまで、あるいは2023年の後半になるであろう開発者向けキットの提供時まで、この製品の価格は発表されないのではないかと考えている。

筆者の勘では、オプティカルインサートは500ドル(約7万円)か、それより高くなるとみている。Snapの「Spectacles」 や一般的なメガネの矯正用レンズは300ドル(約4万2000円)未満で購入できるが、今回の場合は一般的なレンズではない。

その場合、Vision Proと矯正レンズを合わせると4000ドル(約55万7000円)ほどになる。何ということだ。

この記事は海外Red Ventures発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する