スマートグラスをかけ、内蔵されたGoogleのAIチャットボット「Gemini」に話しかける。するとGeminiが視界に入っているものについて説明し、開いていた本のページを要約し、YouTubeで観ていた動画のロケ地を特定してくれる――この体験は、情報へのアクセスがかつてないほど容易になる未来を予感させるものだった。現在はスマートフォンやPCを介してAIを使うのが一般的だが、GoogleはAIを「顔」にも常駐させようとしている。

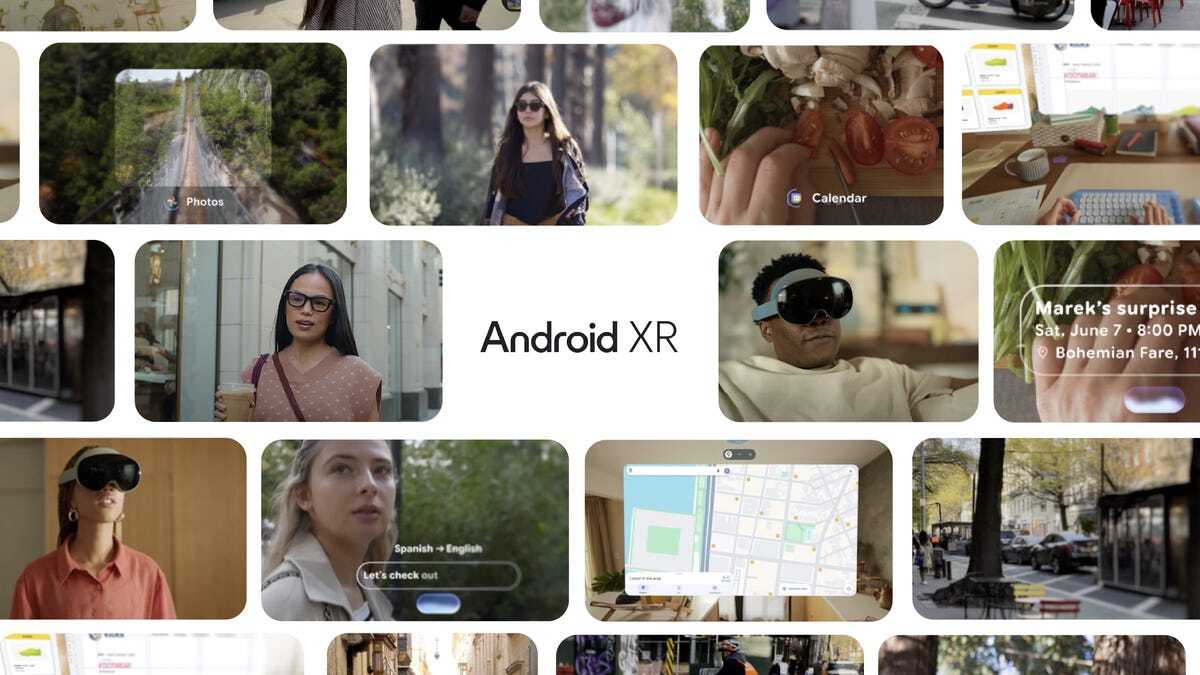

提供:Google

提供:Google

筆者がGoogleの新OS「Android XR」を初めて試したのは2024年12月のことだ。この新たなOSの詳細が今、明らかにされつつある。Googleはすでに2024年の時点で、スマートグラスを今後の製品計画の柱に掲げていてた。そして2025年、筆者は開発者会議「Google I/O」の開催に先立ち、GoogleのAndroid XR担当バイスプレジデント兼ゼネラルマネージャーであるShahram Izadi氏に独占インタビューを行い、今後の展開について話を聞いた。話題は、Googleがサムスンと共同開発し、2025年に登場予定の複合現実(MR)ヘッドセットに始まり、「Warby Parker」などのメガネブランドとの提携から生まれる、さまざまなスマートグラスにも及んだ。

Apple、Meta、Googleといったテクノロジー大手が、AIとコンピューティングの「次のフロンティア」として、スマートグラスに注目し始めている。販売台数こそスマートフォンに遠く及ばないものの、スマートグラスにはユーザーの視界を共有し、視覚データを分析し、AIを使ってユーザーと自然に対話ができるという強みがある。このため、スマートグラスがハイテクガジェットの世界で次のブームを巻き起こす可能性はあるが、現時点ではまだその段階には至っていない。

今、Googleが作ろうとしているAndroid XRデバイスは、既存のスマートフォンを補完するものであって、置き換えるものではない。「将来はスマートグラスがスマートフォンを置き換えるという意見もあるが、変化はエコシステムが徐々に広がるという形で進むだろう」と、Izadi氏は言う。「しかしGemini、そしてAIにとっては、XRが次のフロンティアになると考えている」

Googleは新OSのAndroid XRをひっさげて、再びスマートグラス市場に参入しようとしている。同社は2013年に「Google Glass」、2016年に「Daydream」をリリースするなど、かつてはヘッドセットを開発していたが、近年はVRやARの分野から距離を置いていた。そして今、これらの市場では熾烈な競争が繰り広げられている。

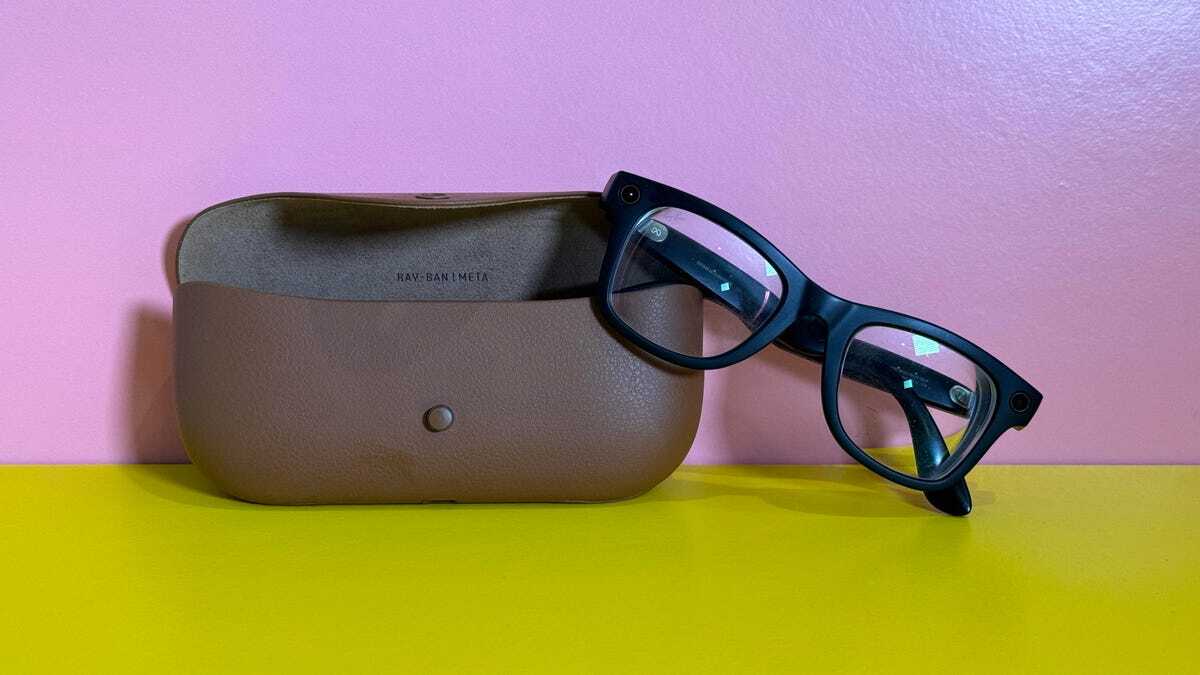

XR(AR、VR、AI搭載ヘッドセット、スマートグラスなどを含む技術の総称)の分野で先行したのは「Facebook」運営元のMetaだ。Metaはヘッドセット「Quest」シリーズやAI搭載の「Ray-Ban Metaスマートグラス」などを展開している。2025年のスーパーボウルでは、俳優のChris PrattさんとChris Hemsworthさんが出演するRay-Ban Metaのコマーシャルが流れた。Appleも高価格帯のヘッドセット「Vision Pro」を市場に投入したが、数年以内に何らかのメガネ型デバイスを発売すると報じられている。

Googleの再挑戦は、サムスンと共同開発しているMRヘッドセット「Project Moohan」から始まるだろう。その後はスマートグラスに軸足を移し、目の前にディスプレイが浮かぶ真のARの実現に向けて、さまざまなスマートグラスの発表が続くとみられている。

Izadi氏は、進化するAIの次の舞台がスマートグラスとなるのは必然だと考えている。スマートグラスには多くのセンサーが搭載され、状況の把握やハンズフリー操作が可能であるため、AIエージェントとの相性がいい。「XRデバイスから背景情報を得られるため、AIアシスタントがユーザーや周囲の状況を理解しやすくなる」と、Izadi氏は言う。

Project Aura

Project AuraGoogleはまず、XREALと共同開発しているARグラス「Project Aura」を開発者向けに公開する。続いてパートナーであるアイウェアブランドから、さまざまなAI搭載スマートグラスを市場に投入する。さらにサムスンとは、次世代ARグラスのリファレンスデザインに共同で取り組む。

こうした製品のすべてに共通しているのがGeminiだ。

AppleのVision ProがiOS向けのアプリストア「App Store」に接続できるように、Android XRもAndroid向けのアプリストア「Google Play」との接続を目指している。しかし、スマートグラスからの接続はまだ先になりそうだ。Izadi氏によると、ARスマートグラスのGoogle Play対応は、まずProject Auraから始まるという。ディスプレイの有無を問わず、Ray-Ban MetaのようなAI搭載スマートグラスについては、Geminiを介してスマートフォン内の情報にアクセスすることになる。

Googleの再挑戦の第1弾となるのは、XREALと共同開発した有線接続型スマートグラスだ。このスマートグラスは常時装着型のウェアラブルではなく、アプリや体験をディスプレイ上に拡張するものとなる。Izadi氏によれば視野角は70度。これは2024年に筆者が試したMetaのスマートグラス「Orion」と同じだが、同じ透明レンズやワイヤレス機能は搭載されないようだ。Project Auraには2つのカメラが搭載され、発売中の「XREAL Air 2 Ultra」と同様にモーショントラッキング、場合によってはハンドトラッキングにも対応する。

XREALは長年、有線接続型のメガネ型ディスプレイを製造してきた企業であり、すでにARグラスを製品化してきた。例えば最新モデルの「XREAL One」はノートPCと接続することで、ディスプレイ領域を拡張できる。さらに最近はSpacetopと提携し、XREALのスマートグラスとWindowsノートPCをつなぎ、複数のアプリやウィンドウを空間に配置する体験を提供した。Googleとの提携により、今後はXREALのスマートグラスから直接Google Playアプリが利用できるようになるかもしれない。

「かさばるヘッドセットと比べて、軽量で持ち運びやすいXRデバイスは大きな進化だ。XREALは長年、こうしたデバイスを目指してきた。技術改良を重ねるたびに、目標に少しずつ近づいた。その結晶がProject Auraだ」と、XREALの創業者で最高経営責任者(CEO)のChi Xu氏は言う。古い話になるが、筆者はXREALが開発した初のスマートグラス「Nreal Light」を試用したことがある。当時は「Magic Leap」風のARグラスを目指していた。そう考えると、今回のProject Auraはある意味、原点回帰と言える。

Izadi氏は、GoogleがXREALと共同開発している製品を「プラグアンドプレイ」型デバイスと表現する。つまり、この製品はXREAL製の既存のスマートグラスと同様にケーブルと接続した状態で使うことを想定している。このスマートグラスは、まずは開発者向けキットとして提供され、Qualcomm製プロセッサを搭載した処理パックから動作する設計だ。将来的にはスマートフォンなどのデバイスとの接続を目指す。「接続可能なデバイスの開発も計画中だ。この分野では、サムスンと面白いコラボレーションができるかもしれない」とIzadi氏は語った。

この新しいスマートグラスは、数年前にQualcommが取り組んでいたARグラスとスマートフォンの接続計画を想起させる。当時QualcommのXR責任者だったHugo Swart氏は現在、GoogleでXRエコシステム担当シニアディレクターを務める。

Ray-Ban Metaスマートグラス

Ray-Ban MetaスマートグラスGoogleもAI対応スマートグラスの開発を推進しており、筆者が2024年に試した製品を含めて、複数の製品がGoogle I/Oに展示されていた。Googleは第1波として、Ray-Ban Metaと競合するAIグラスを市場に投入する計画を温めており、すでに大手アイウェアブランド(例:Warby Parker)や韓国のファッションブランド「Gentle Monster」、高級アイウェアブランド「Kering Eyewear」などとパートナーシップを結んでいる。

Izadi氏は、スマートグラスの発売時期や価格の詳細は語らなかったが、アイウェアブランドと提携することで開発のペースは速まるはずだ。「AIスマートグラスの実現に向けて全力で取り組んでいる」と、Izadi氏は言う。「充実したパイプラインの構築が急務だ。特に度付きメガネの場合、実店舗での試着や視力測定が必要となるため、こうしたパートナーシップが非常に重要になる」

Googleがスマートグラスに搭載しようとしているAI機能の一部は、すでにRay-Ban Metaにも搭載されている。例えば音楽の再生、メッセージの送信、カメラが捉えたものの説明、ライブ翻訳などだ。しかし、Googleはさらに高度な機能、例えばカレンダーや予定の確認、スマートフォンに入っている情報のコントロールなども視野に入れている。AI機能とスマートフォンの高度な統合こそ、MetaにはないGoogle独自の優位性として、筆者が注目しているものだ。

アシスト機能も重要な役割を果たす。視力を補うためにRay-Ban Metaを使っている人の存在は筆者も知っている。Appleは「AirPods Pro 2」に補聴器機能を搭載した。Googleのスマートグラスも、聴力や視力といった人間の機能を補助することを大きな目標にしているとIzadi氏は認めた。

こうしたスマートグラスが2025年に登場する可能性は低いが、2026年に登場する可能性は非常に高い。

Project Moohan

Project MoohanGoogleのスマートグラス戦略における最大の、そして最も謎めいた要素がサムスンとのパートナーシップだ。Googleがサムスンと共同開発している初のAndroid XRヘッドセット「Project Moohan」は2025年に登場予定だ。Project MoohanはGoogle I/Oでも展示されており、筆者も試したことがある。AppleのVision Proに似たコンセプトを持ち、Google Playの2Dアプリ、3Dアプリ、そして映ったものを認識できる「Gemini Live」を実行できる。

しかしサムスンとGoogleの協力はヘッドセットにとどまらず、理想のARグラスを実現するためのハードウェアとソフトウェアの開発にも及んでいる。これはGoogleのビジョンを実現する上で欠かせないステップだとIzadi氏は言う。「サムスンとGoogleは、リファレンスハードウェアを含む、コアプラットフォームに共同で取り組んでいく」とIzadi氏は筆者に語った。とはいえ、こうしたステップの実現はさらに先の話となりそうだ。差し当たり、より大型のProject MoohanがARに近い体験を探る手段となりそうだ。一方、スマートグラスの第1歩はProject Auraで進められており、それより早くAIグラスが店頭に並ぶ可能性もある。

これらのスマートグラスやヘッドセットは流動的であるように思えるが、一貫した軸となるのはGeminiだ。Googleは同社のAIをウェアラブル機器のカメラと連携させることに注力している。AIツールの進化とともに、ARグラスの全体像も進化していくだろう。

現時点でGoogleは遅れを取り戻さなければならない。Project MoohanはAIがVRとARをどう融合できるかを示すという点で有望だが、その価格は3500ドル(日本では税込59万9800円)のVision Proと同様に、多くの潜在的購入者には手が届きにくいものになりそうだ。Project Auraについては、XREALが6月のARカンファレンス「AWE」で詳細を明かす予定だ。

Izadi氏は、こうした初期モデルの一部には同社が最終的に目指すフルスペックのARグラスと比べて妥協点があると認めつつも、価格・機能・サイズ・処理能力の異なる幅広い製品ラインアップを用意することが正しい道筋だと語る。

「われわれはビデオシースルーのヘッドセットから、広視野角の光学シースルーヘッドセット、XREALのようなデバイス、真のARグラス、そしてよりヘッドアップ型またはディスプレイすらないAIグラスまで、幅広い製品群を視野に入れている」と同氏は述べる。Googleは、ARグラスの機能がまだ開発途上にある中で賭けを分散させているようだ。

今後登場するこれらの製品群の中では、AI対応スマートグラスが勝ち筋であるように思える。Googleは現在AIの能力にフォーカスし、AR関連のアイデアを将来に向けて構築している。

この記事は海外Ziff Davis発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

CNET Japan Live 2025開催レポート

CNET Japan Live 2025開催レポート

イノベーションの「種」から社会実装へ--

社会課題の解決に挑む各社の挑戦

議事録作成もデジタル変革!

議事録作成もデジタル変革!

地味ながら負荷の高い議事録作成作業に衝撃

使って納得「自動議事録作成マシン」の実力

無限に広がる可能性

無限に広がる可能性

すべての業務を革新する

NPUを搭載したレノボAIパソコンの実力

川崎重工が目指す共創の在り方

川崎重工が目指す共創の在り方

「1→10」の事業化を支援する

イノベーション共創拠点の取り組みとは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する