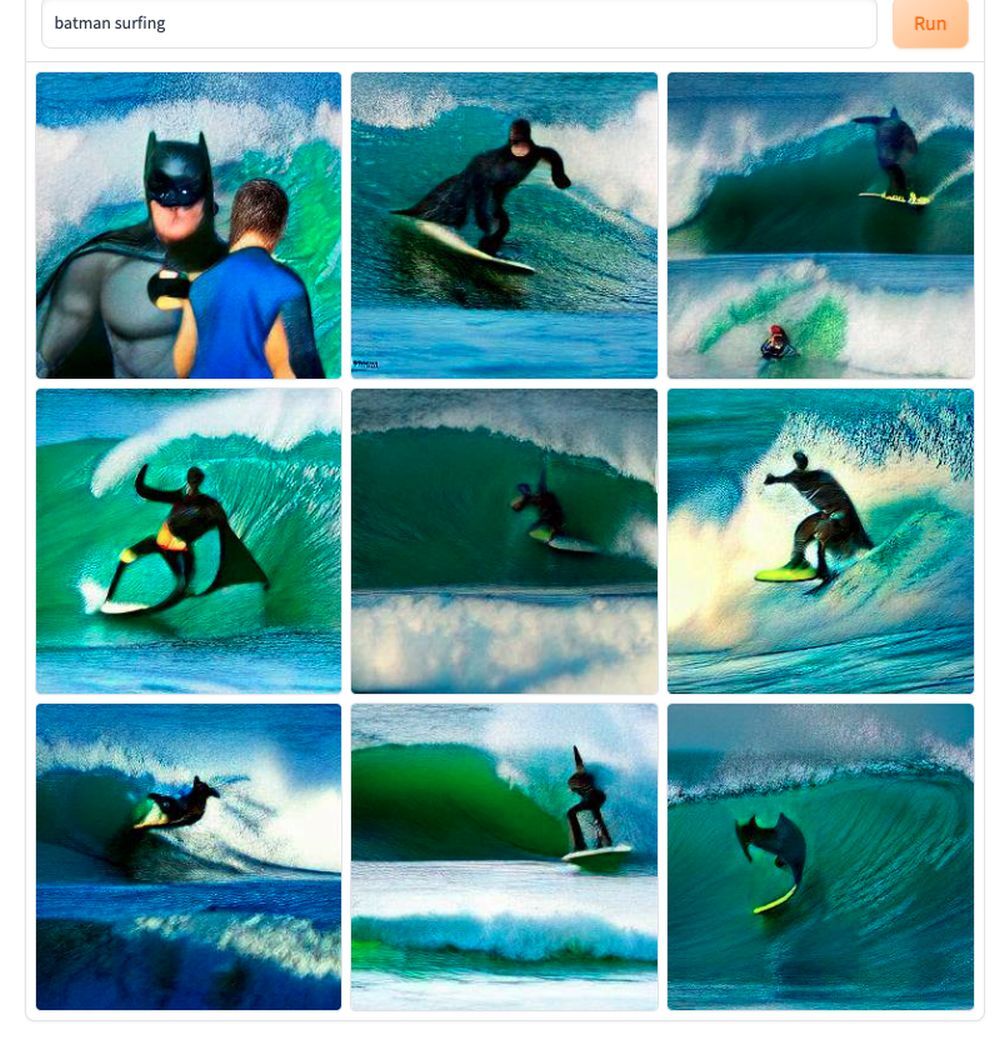

インターネットでは、悪夢の燃料に事欠くことはない。最新の燃料は、「DALL·E mini」だ。入力されたテキストに基づいて、奇妙な画像や面白い画像、時には、不快感をもたらす画像なども作り出すAIツールで、ソーシャルメディアで注目を集めている。

DALL·E miniは、画像(理論上、ユーザーの魂の奥深くにしか存在しないイメージ)を説明する短いフレーズを入力すると、数秒でその画像が画面に表示されるというものだ。

読者もソーシャルメディアのフィードでDALL·E miniの画像を見たことがあるだろう。ユーザーが思いつくフレーズは「ハムを食べるJon Hamm(米国の俳優)」や「コンビニ強盗をするヨーダ」など、極めて突拍子もない。

アートと人工知能の組み合わせがインターネットユーザーの注目を集めるのは、今回が初めてではない。アートのような主観的なものをアルゴリズムがどのように扱うのか、という問題には、ある種、興味を引くものがある。例えば、2016年には、俳優のThomas Middleditchが、アルゴリズムによって書かれた脚本を基に短編映画を制作している。Googleも、アートとAIを結び付けるツールをいくつか開発しており、2018年には、自分に似た顔が描かれた有名絵画を探せる「Google Arts & Culture」というアプリを発表している。また、Googleの「AutoDraw」は、ユーザーが描こうとしているものを見抜き、修正もしてくれるツールだ。

OpenAIの「DALL·E 2」や「Google Imagen」など、一般の人々にまだ提供されていないテキスト画像生成システムもある。

DALL·E miniとそのAIで生成されたアートについて知っておくべきことを以下で解説する。

DALL·E miniは、入力されたテキストに基づいて画像を生成するAIモデルだ。プログラマーのBoris Dayma氏がニュースサイト「i」とのインタビューで語ったところによると、DALL·E miniは当初、GoogleとAIコミュニティーの「Hugging Face」が開催したコンテスト用に、2021年7月に開発したものだそうだ。米CNETはDayma氏にコメントを求めたが、すぐに回答を得ることはできなかった。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

無限に広がる可能性

無限に広がる可能性

すべての業務を革新する

NPUを搭載したレノボAIパソコンの実力

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する