その対極にあるのは、人間の周囲で自律的に動くのではなく、人間と連動することによってのみ動くロボットだ。例えば、サムスンのウェアラブルロボット「GEM」は、自力での移動が困難な人をバイオニック技術で補助するように設計されている。このような外骨格ロボットは、足首や膝、腰の動きを支援することによって、文字通り人間の肉体的な労働の負担を軽減する。

しかし、ロボットはウェアラブルなものでなくても、人間の接触に反応することができる。LOVOT(孤独感を和らげるGROOVE Xのコンパニオンロボット)のようなドロイドを見ると、ロボットがどのように人間の行動に物理的に反応するのかが分かってくる。LOVOTは内蔵のタッチセンサを通して、自分が持ち上げられていること、くすぐられていること、抱きしめられていることなどを検知し、それぞれ、車輪を内側に収納する、声を出して笑う、熱を発して眠るといった反応をする。

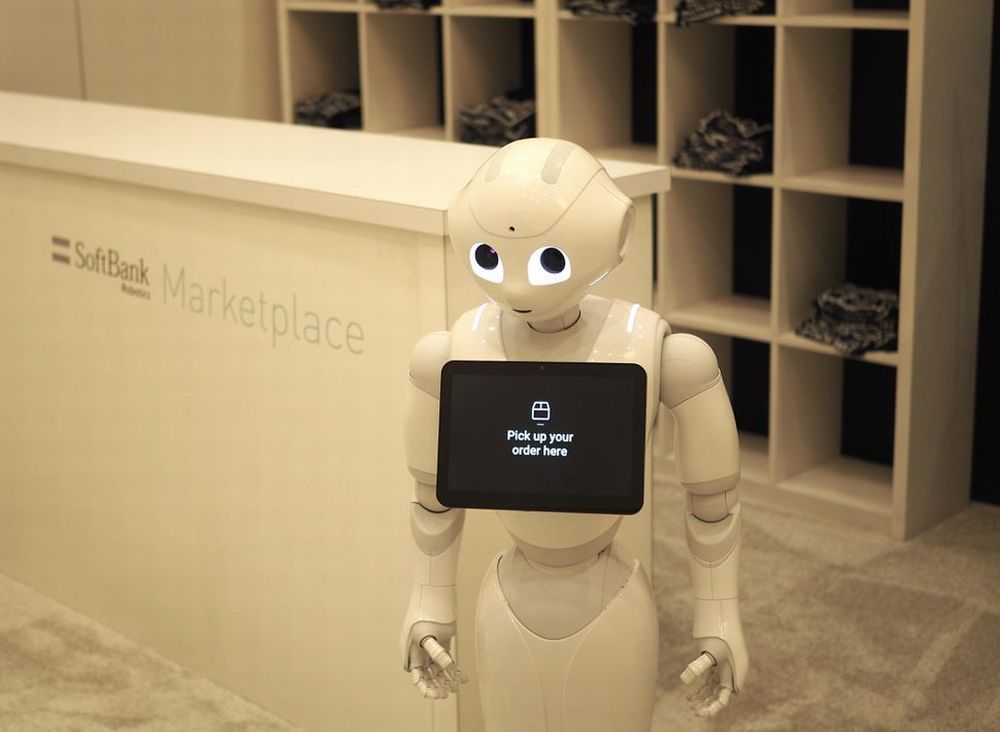

ソフトバンクの「Pepper」と再会して分かったことがある。筆者が何者なのかをロボットが自動的に認識し理解してくれたら、ロボットと人間のやり取りを全く新しいレベルに引き上げられる、ということだ。

この特定のデモでは、筆者は「iPad」を使ってオンラインショッピングし、購入した商品を店頭で受け取ることになっていた。決済プロセスを進めていると、iPadのカメラを使って自分の顔写真を送信するよう求められた。

その結果、筆者がベネチアンホテルの一角に設営されたソフトバンクの仮設店舗を訪れると、Pepperは名前を呼んで出迎えてくれた。それから注文内容を呼び出し、商品を受け取りたいかと尋ねた。「はい」と答えると、Pepperの横に人間の担当者が現れ、注文していたシャツを渡してくれた。

それはシームレスな体験であり、オンラインで商品を注文して店頭で受け取る際に付きものの煩わしさを一切感じずに済んだ。通常なら、そのプロセスには、デスクで列に並んで、注文番号を照会し、担当者に伝え、その担当者が倉庫で商品を探して戻ってくるまで待つという体験が伴う。

Pepperは2018年、Affectivaの、音声や視覚的な手がかりを利用して人間の感情を解釈する「Emotion AI」のおかげで、一連の新たな能力も獲得した。長い目で見れば、感情を知覚し解釈する能力は向上し続け、人間とコンパニオンロボットまたは顧客サービスロボットの間のやり取りもより有意義なものになるはずだ。

これは、人間の相棒となることを目指して設計されたLOVOTのようなロボットにとって、特に有用なことかもしれない。LOVOTの頭頂部には、最大1000人の顔を見分けられる顔認識カメラが搭載されている。LOVOTはこのカメラを使って、ユーザーが誰なのか理解し、その人との関係を築く。

人間にロボットとの絆を深めるように働きかける上で、身体的な接触は重要な要素である、とLOVOTを開発したGROOVE Xの代表取締役である林要氏はCESの会場で筆者に話してくれた。だが、このプロセスに重要な要素はほかにもある。同氏によると、アイコンタクトや、ロボットが人間を認識する能力も重要だという。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する