公共交通機関で移動するときは「Smart Ride」を使用するが、それ以外の場合は、UberやLyftのアプリを使うという。

「移動の準備ができたら、UberかLyftを呼ぶだけで、自動車が自分の立っている場所まで迎えに来てくれる。ドライバーに運賃を払う必要もない(支払いはアプリを通して処理されるため)。この方がはるかに楽だ」(Kidkulさん)

アクセシビリティー開発の目的は、単に新しいボタンや機能を追加することだけではない。多くのアプリには、全盲者や視覚障害者の日常生活を楽にする技術が組み込まれている。

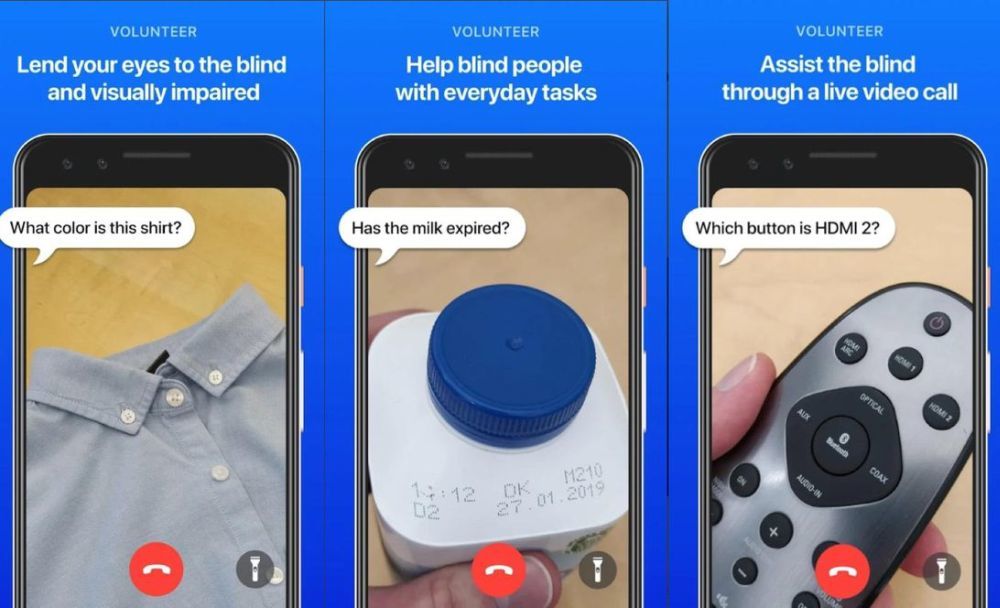

「Be My Eyes」アプリはビデオ通話によって、晴眼者のボランティアと、援助を必要とするユーザーを結び付ける。ライブ通話では、食品の賞味期限やカメラを向ける場所を確認したり、色を区別したり、説明書を読んだりするのを助けることができる。

Kidkulさんが毎日使用するSeeing AIアプリは、人工知能を使って商品のバーコードや商品名、説明書、通貨を読み取る。さらに、このアプリは色やさまざまな物体の違いを区別するのにも役立つ。友達を認識できるようにしたり、周囲の人間の特徴を説明したりすることも可能だ(表情を識別することもできる)。

2019年に入って、中国のエレクトロニクス大手の華為技術(ファーウェイ)は、AI顔認識ソフトウェアで7種類の感情を識別できる「Facing Emotions」アプリをリリースした。AIに加えて、Facing Emotionsは同社の「Mate 20 Pro」のカメラも使用して、感情を耳で伝わる音に変換する。

Instagramも、アプリを全盲者や視覚障害者が利用しやすいものにする取り組みで、大きな進歩を遂げている。Instagramの現行のアプリには、代替テキストとカスタムの代替テキストが含まれる。自動代替テキストは画面読み上げ機能と連携して、写真がどういうものなのかをユーザーに説明する。

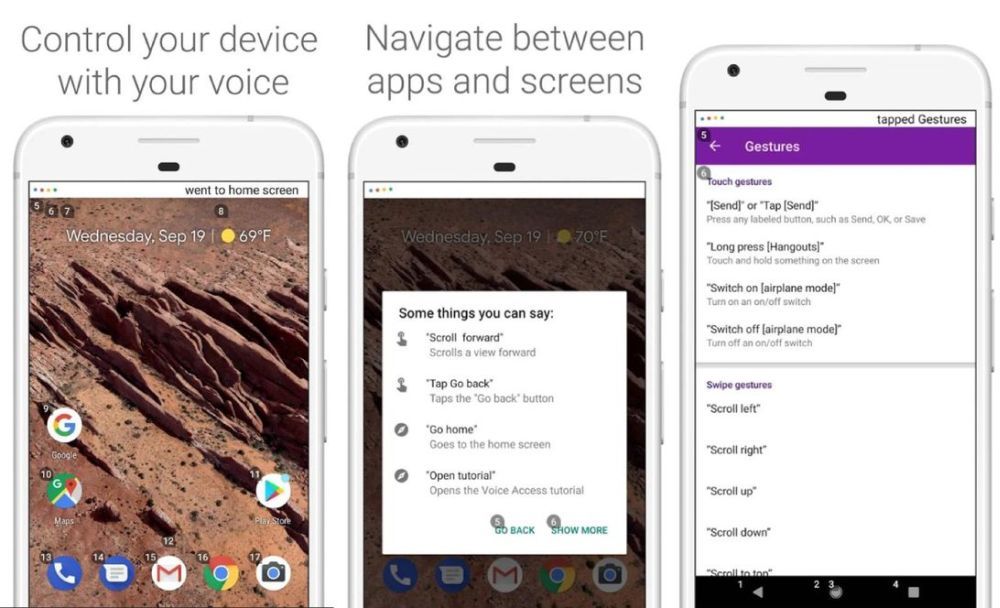

音声コマンドをアプリに組み込むことで、より安全に運転するといったアクションや天気情報を取得するなどの単純な作業が容易になる。これは、全盲者や視覚障害者のアクセシビリティーに極めて大きな変化をもたらす。

2018年10月、Googleのアクセシビリティーチームは「Voice Access」アプリを発表した。このプログラムにより、ユーザーは「Android」デバイスを完全にハンズフリーで操作できる。Voice Accessは音声コマンドで作動し、機能やアプリに番号を割り当てる。ユーザーは「OK Google」と言って、テキストの入力や画面のスクロール、アプリの操作などを実行できるようになっている。

このアプリは体の不自由な人向けに設計されているが、全盲者や視覚障害者にも有用かもしれない。

この1年間に音声コマンド機能を追加または拡張したほかのアプリには、Android版YouTubeやPandoraなどがある。

GoogleはCES 2019で、Androidデバイスがロックされていても、「Googleアシスタント」が応答して機能するようになることを発表した。

Kidkulさんはライドシェアアプリと公共交通機関を利用しているが、将来的に、全盲者や視覚障害者にとってより大きな可能性があるのは、自動車の中かもしれない。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する