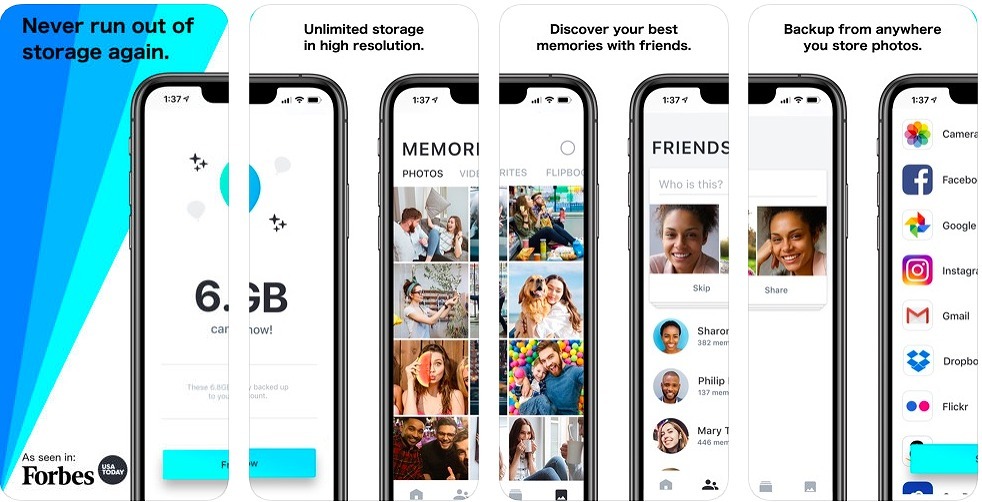

写真の保存やバックアップができるアプリ「Ever」は、アップロードされた多くの画像を商用顔認識システムのトレーニングに使用したと報じられている。NBC Newsによると、問題は、Everがこのことをユーザーに公表しなかった点だという。

Everアプリにアップロードされた写真は、同社の顔認識製品「Ever AI」で使われるアルゴリズムのトレーニングに利用されていると、NBC Newsが米国時間5月9日に報じた。NBC Newsによれば、ウェブサイトを見てもはっきりと書かれていないが、Everは4月にプライバシーポリシーを更新し、顧客の写真の用途に関する情報を追加したという。Everのユーザー7人にインタビューしたところ、自分たちの写真が顔認識技術の構築に利用されていると知らない人がほとんどだったとNBC Newsは伝えている。

最高経営責任者(CEO)のDoug Aley氏はNBC Newsの取材に対して、Ever AIは、写真や個人を特定できる情報を顔認識技術の顧客に提供してはいないと答えている。

NBC Newsによると、Ever AIは、ソフトバンクロボティクスなどの民間企業と契約しているが、「法執行機関や軍、国家安全保障機関」とは契約を交わしていないという。

顔認識システムの開発者は、ソフトウェアプログラムに多くの写真を学習させて人の顔をどう認識するかを人工知能(AI)に教え、システムをトレーニングする。画像は多ければ多いほどいい。だが、一部の顔認識システム開発者は、ソフトウェアをトレーニングするのに十分な画像を所有しておらず、人々の同意なく勝手に画像を利用してきた。

これは、プライバシーの問題だ。オンラインに写真をアップロードする人々の中には、監視技術の開発に画像を利用されたくない者もいる。顔認識は警察、空港や店舗で使われており、議員らはこの技術がどのように運用されているかについて懸念を表明している。サンフランシスコの議員らは、市当局が顔認識を利用するのを禁止する米国初の都市になりうる条例案を提出した。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する