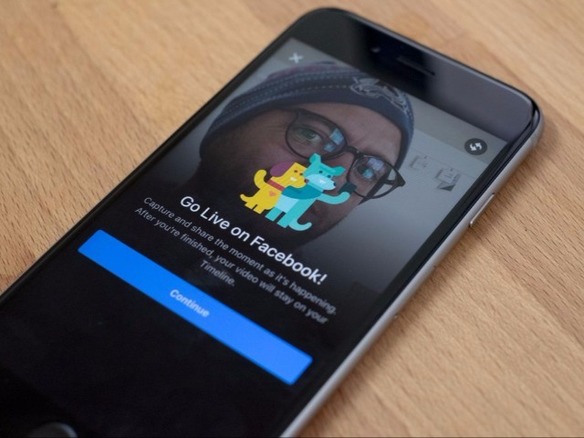

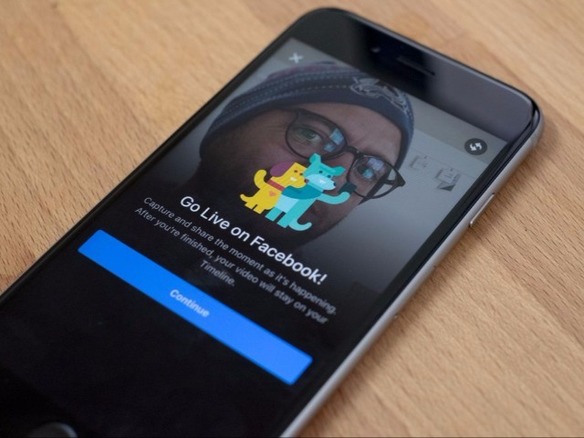

Facebookから流出したとされる内部文書の情報としてThe Guardianが報じたところによると、Facebookユーザーが自傷行為のライブ配信を認められているのは、同社が「自殺を試みようとして苦しんでいる人々を検閲したり、罰したりしたくない」からだという。

それらの文書によると、「その人物を助ける機会が失われてしまったら」、その事件にニュース価値がない限り、その画像はサイトから削除されるという。そのポリシーは、100を超える内部文書やマニュアルに書かれていた。それらの文書を読めば、Facebookが暴力やヘイトスピーチ、テロリズム、ポルノ、人種差別、さらには人肉嗜食までもを含む同サイト上のコンテンツをどのようにモデレートしているのかが分かる、とThe Guardianは伝えている。

The Guardianによると、自傷行為がFacebookに投稿される事例が増加しており、Facebookはこうした状況を憂慮しているという。The Guardianが調べた文書によると、2016年夏の2週間に4531件の自傷行為が報告されたが、2017年の同様の期間には5431件が報告されたという。

報道によると、Facebookはモデレーターと共有したポリシーアップデートの中で、「自殺も含めて、Facebook上で動画コンテンツが共有されることが増えている。自殺を試みようとして苦しんでいる人々を検閲したり、罰したりしたくない。これらの人々の安全にとって最良のことは、彼らが閲覧者と関わりを持っている限り、ライブ配信を続けさせてあげることだ、とわれわれは専門家たちから聞いている」と述べたという。

「ただし、伝播リスク(つまり、自殺を目撃した人は自殺を考える可能性が高くなる)もあるので、これらの動画を見る人々の安全にとって最良のことは、配信者を助ける機会が失われた時点で、われわれが動画を削除することだ。われわれはニュースとしての価値を検討する必要もある。特定の瞬間や公的な出来事が広く一般の人々の間で話し合われているときは、それらを削除せずに公開し続ける方が適切かもしれない」

これらの文書では、FacebookのモデレーターがリベンジポルノやDonald Trump米大統領に対する脅迫、動物虐待の画像など、問題のあるさまざまな活動を含む投稿に対処すべき方法が説明されているという。

Facebookはそれらの文書が本物であると認めることは控えたが、ユーザーの安全が同社の最大の関心事だと述べた。

「より多くの人に投資することに加えて、われわれはコミュニティーの安全を維持するため、より良いツールの構築にも取り組んでいる。このツールについて、さらに問題を報告しやすく、当社の基準に違反する投稿をレビュアーがより早く判断できるようにし、また支援を必要とする人がいれば法執行当局に連絡しやすいようにしていく」(Facebook)

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する