想像してみてほしい。スキルアップのために、学習したり訓練したりするだけでなく、他人の脳に接続して彼らの経験を直接利用できるとしたらどうだろうか。

人類にとっては、それはまだSFの中の話だが、人工知能(AI)搭載ロボット工学の分野では、複数のロボットが経験を共有することで訓練時間を短縮することが可能だ。Googleは最近、握持能力のあるロボットアームを用いてこれを実証してみせた。

6年前、Googleのロボット事業の当時のリーダーだったJames Kuffner氏が、こうしたタイプの技能獲得方法を「クラウドロボティクス」と名付けた。この方法は、データセンターと高速なネットワークにより可能になる分散型センサと処理能力の効果を認めるものとなっている。Kuffner氏は現在、Toyota Research Instituteの最高技術責任者(CTO)として、家庭用ヘルパーロボット実現に向けたクラウドロボティクス研究に従事している。

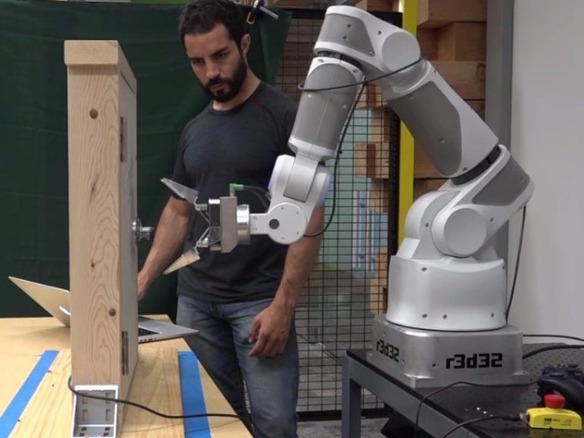

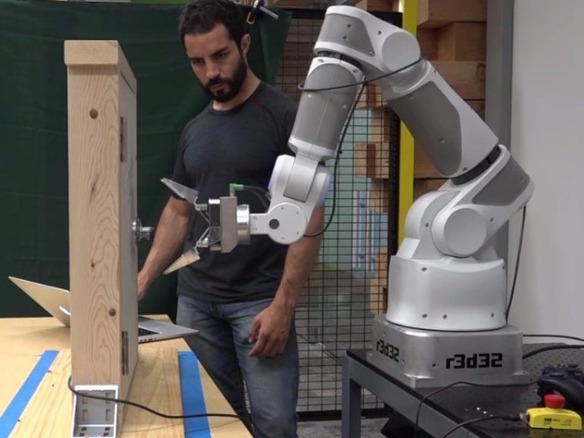

Google Research、その傘下で英国に拠点を置くAI研究所のDeepMind、Google Xもクラウドロボティクスの研究を続け、ロボットによる汎用的スキル獲得の推進を目指している。Googleは米国時間10月3日に公開した幾つかのデモ動画で、ロボットが物体を押して移動させる方法とドアを開ける方法を迅速に習得するために共有体験を活用する様子を紹介した。

Googleの研究者らは、複数のロボットを用いる3種類の手法を採用している。その1つは、強化学習、つまり試行錯誤をディープニューラルネットワークと組み合わせたものだ。これは、DeepMindがAIにAtariのビデオゲームと囲碁を習得させるための訓練に用いたのと同じ方法だ。

各ロボットはそれぞれ独自のニューラルネットワークを持ち、このニューラルネットワークが、ドアを開くための最適な行動を判断するのを支援する。Googleの研究者は干渉を加えることによって、データをより迅速に構築する。中央のサーバは各ロボットの行動、態度、行動の結果も記録し、それらの経験データを活用して、より良いニューラルネットワークを構築する。これにより、ロボットたちはタスクをさらに上手にこなせるようになる。

Googleの2本のデモ動画では、20分間の訓練の後、ロボットアームはドアの取っ手をぎこちなく探し回り、最終的には取っ手を探り当ててなんとかドアを開いた。だが、3時間たたないうちに、ロボットは取っ手を着実につかみ、ひねり、引いてドアを開くようになった。

研究中の2つ目の方法は、ロボットに命令して家の中の物体を移動させるのに役立つだろう。Googleはロボットに、物体に対する行動の結果、その物体がどう動くかに関するメンタルモデルを構築するよう教え込んでいる。メンタルモデル構築の方法は、ある行動の結果、画面上の画素がどこに移動するかという経験を蓄積するというものだ。

この方法では、ロボットたちはテーブル周辺のさまざまな物体を押して動かす体験を共有する。このことは、行動が引き起こす結果を各ロボットが予測するのに役立つ。

3つ目として、研究者らはロボットに人間から学ばせる方法を模索している。研究者はロボットの腕をドアに導き、実際にドアを開けさせることで開け方を教える。一連の動作は、カメラに映った画像をロボットの行動に変換するディープニューラルネットワークにエンコードされる。

ロボットたちは人間に開け方を教わった後、自分自身でドアを開ける動作を試み、その経験を共有する。さらに、試行のたびにドアの位置を変えることによって、ロボットは徐々に作業精度を上げることができ、数時間中にさらに器用に対応できるようになった。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する