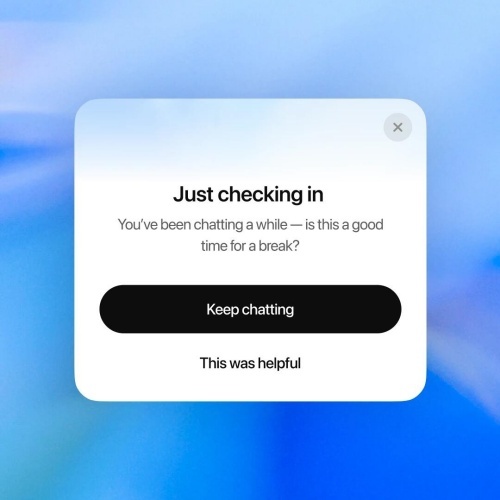

OpenAIは米国時間8月4日、「ChatGPT」との会話の中で休憩を促す機能を導入すると発表した。ChatGPTと長時間やり取りを続けると、ソーシャルメディアと同様に依存的な行動につながるおそれがあるため、一定時間が経過すると休憩を促すポップアップが表示される。

提供:NurPhoto/Getty Images

提供:NurPhoto/Getty Images

「私たちは利用時間やクリック数で成功を測るのではなく、皆さんが目的を果たしてサービスを離れているかを重視している」と同社は発表の中で述べた。

この変更が実際に効果をもたらすかは未知数だ。スタンフォード大学医学部の精神科医で教授のAnna Lembke博士は、こうした機能が強迫的な行動を抑制するかという点について、ソーシャルメディアやIT企業はデータを公開していないと指摘する。「臨床の経験から言えば、こうした軽い促しは依存度が軽い人には有効かもしれないが、深刻な依存状態の人にはあまり役立たない」と同氏は語った。

OpenAIがChatGPTを改良する背景には、AIの利用がメンタルヘルスに与える影響への注目が高まっていることがある。多くの人がAIツールやAIキャラクターをセラピスト代わりに用い、その助言を医療の専門家から受けたもののように信用している。しかし、AIは誤った有害な回答を返すことがあるため、リスクは大きい。

プライバシーも問題だ。人間のセラピストは会話の秘密を守る義務を負うが、OpenAIは訴訟でその情報を守る責務や権利を有していないと、最高経営責任者(CEO)のSam Altman氏は最近認めている。

その他の目立たない変更点として、OpenAIはChatGPTのモデルを調整し、深刻な問題に直面しているユーザーに、より適切に対応できるようにする。同社によれば、ユーザーが妄想など問題のある兆候を示しているのに、認識せず適切に応答できなかったケースがあるという。「今後もモデルの改良を進めるとともに、精神的・感情的な苦痛の兆候をうまく検知し、ChatGPTが適切に対応して、必要に応じてエビデンスに基づくリソースを提示できるようにするためのツールを開発していく」(同社)

また、ChatGPTが人生の大きな決断に関する助言を与えるような場合にも、より慎重に回答できるようにするという。OpenAIは「恋人と別れるべきか」といった質問に対し、単に答えを示すのではなく、ユーザー自身が考えて答えを出せるよう、問い掛けなどをして導くと説明している。この変更は近く適用される予定だ。

ChatGPTの休憩を促す機能によって生成AIの利用時間が短くなるは不透明だ。作業中に休憩が必要かと聞かれるのは煩わしいと思う人もいれば、外に出て気分転換するきっかけが欲しい人もいるだろう。

Lembke氏は、チャットボットなどを利用する際は時間管理を徹底すべきだと述べる。ソーシャルメディアなど他の依存性の高いサービスでも同様だ。利用を控えめにする日や、全く使わない日をあらかじめ決めておくとよい。

「利用時間を意図的に制限し、具体的な上限を設けるべきだ」と同氏は語る。「プラットフォームで何をするか具体的に書き出し、その用途に留め、寄り道して深みにはまらないようにする必要がある」

OpenAIの発表この記事は海外Ziff Davis発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

【独占】生成AI勃興でリストラ敢行 巨額調達ダイニーが人材削減に踏み切った理由

【独占】生成AI勃興でリストラ敢行 巨額調達ダイニーが人材削減に踏み切った理由

【独占】みずほFG傘下の道を選んだUPSIDER宮城社長インタビュー 「スイングバイIPO当然目指す」

【独占】みずほFG傘下の道を選んだUPSIDER宮城社長インタビュー 「スイングバイIPO当然目指す」

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する