ほとんどの人が何らかのアルゴリズムに日々接している一方、人工知能(AI)がどのように機能するのか、実際に理解していると自信を持って言える人はそれほど多くない。しかし、Googleが英国で現地時間11月20日から開催している「Google Cloud Next '19 UK」で発表した新たなツールは、一般の人々が機械学習(ML)の難解さをひもとくうえで力となるはずだ。

「Explainable AI」(説明可能なAI)と呼ばれるこのツールは、MLモデルが思考を重ねる手法と、結論に至った理由をユーザーに説明するという、その名が示す通りの機能を有している。

Explainable AIは、そういった機能を実現するために、データセット内の各特徴がアルゴリズムの導き出した結果にどの程度の影響を与えたのかを定量化する。つまり、それぞれのデータ係数には、MLモデルにどの程度影響を与えたのかを示すスコアが割り当てられる。

ユーザーはそのスコアを参照することで、あるアルゴリズムが何らかの判断を下した理由を理解できるようになる。例えば、誰かに対する融資の承認可否を決定するモデルの場合、Explainable AIは口座残高や信用度が最も重要なデータであることを示してくれる。

同ツールは現在、Googleの「AutoML Tables」上と「Cloud AI Platform Predictions」上でホストされているMLモデルに対して適用できる。

Googleは過去にもアルゴリズムの透明性を高めるための取り組みを実施している。同社は、そのAIプラットフォーム上で作業する際のデータセットの可視化機能と探査機能を開発者に提供する「What-If Tool」を発表している。

Explainable AIがデータの係数を定量化することで、さらに深い洞察がもたらされるとともに、そういった洞察がより多くの人たちに分かりやすく伝えられるようになる。

Google CloudのCloud AI戦略担当ディレクターTracy Frey氏は、「AI ExplanationsとWhat-If Toolを組み合わせて、モデルの振る舞いの全体像を示すこともできる」と述べた。

医療などの一部の分野では、AIの透明性を向上することは特に有用だろう。

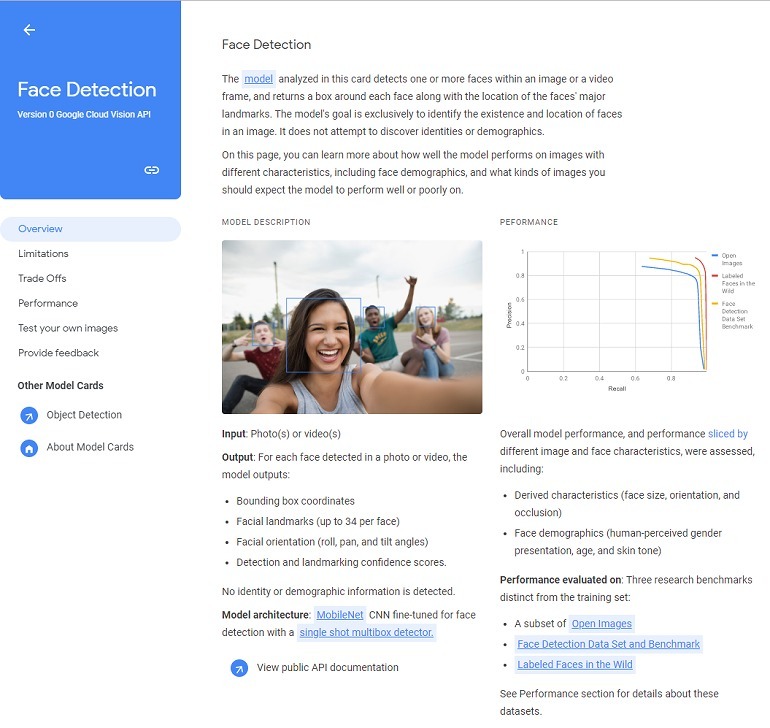

同社は「モデルカード」と呼ぶ新たなコンセプトの立ち上げも発表した。モデルカードとは、特定のアルゴリズムについての簡潔な情報を提供する短いドキュメントだ。

このドキュメントは、モデルのパフォーマンスや制約に関する実用的な詳細を含んでおり、実質的にMLモデルの身分証明書のようなものと言える。

同社は、これにより「開発者はどのモデルをどういった目的で、どのように配備するのが責任あるやり方なのかについて、より優れた判断を下せるようになる」と述べている。

Googleは既に、モデルカードの実例として、顔認識アルゴリズムと物体検知アルゴリズムの2つを公開している。

ユーザーはモデルの出力やパフォーマンス、制約について確認できるようになる。例えば、顔認識モデルカードでは、このアルゴリズムが顔の大きさや向きのほか、光源の品質によって左右されることが説明されている。

今回発表された新しいツールや機能は、テクノロジーを開発する上でさらなる透明性を求める、AIの基本理念に忠実な姿勢を示そうとするGoogleの取り組みの一端だ。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する