モスクワにあるサムスンの人工知能(AI)センターの研究者らが、顔の静止画像から「人が話をしている動画」を生成できる新システムを開発した。

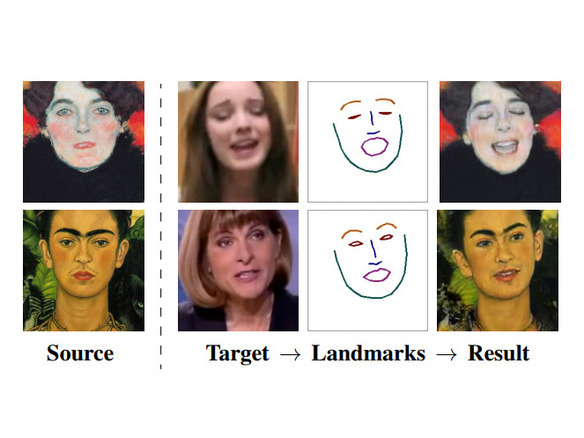

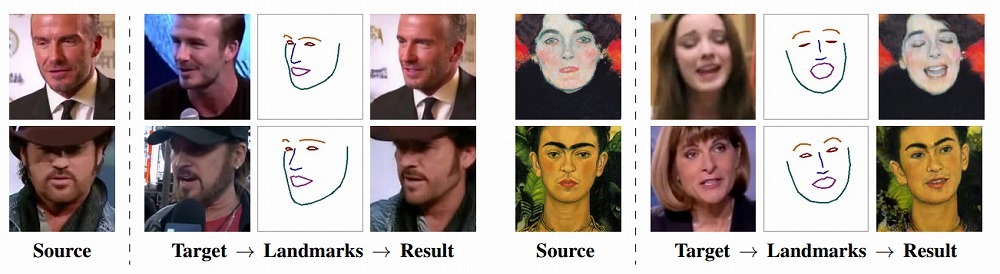

この研究によると、このシステムは、ターゲットとなる顔から抽出したランドマーク(顔の輪郭や目、眉、口などを単純な線で表したもの)をソースとなる顔(たとえば静止画像)に当てはめ、ターゲットとなる顔の動きに合わせてソースとなる顔の表情が動く、実物そっくりな会話中の顔を作る。

サムスンは次のように述べている。「こうした機能には、ビデオ会議やマルチプレーヤーゲームなどのテレプレゼンスのほか、特殊効果業界向けの実用的な用途がある」

「ディープフェイク」技術の存在は目新しいものではないが、サムスンの新システムは3Dモデリングを使用せず、顔のモデルを作るのに1枚の写真しか必要としない。システムがモデルを作成するのに32枚の画像を使用できれば、「完全なリアリズムとパーソナライズを実現」できる、とサムスンは述べている。

サムスンによると、限られた量の写真から「ディープフェイク」動画を作成できるのは、システムに会話中の顔の動画を集めた大規模なデータバンクがあり、外見の異なるさまざまな話し手に対応できるからだという。ソースとなる顔のランドマークとともにこのデータバンクを利用することで、新システムはリアルな外見のさまざまな顔モデルを生成できる。

その後、このシステムは、さまざまな顔モデルを互いに比較してどのモデルが最も「リアル」かを判断する敵対的生成ネットワーク(GAN)を利用する。生成された各モデルを絞り込んで、動画に使用する最終的なモデルを選択できる。

「ディープフェイク」動画は現在、米国の議員らにとって大きな懸念材料となっている。AIに操られて実際には言っていないことを言う人の動画が、国家安全保障上の脅威になりうると心配しているのだ。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する