5月、改正プロバイダ責任制限法が参院本会議で可決、成立した。公布から1年以内に施行され、法律名は「特定電気通信による情報の流通によって発生する権利侵害等への対処に関する法律」、通称「情報流通プラットフォーム対処法」(情プラ法)に改められる。今注目の「情プラ法」について解説したい。

この改正は、誹謗(ひぼう)中傷などのインターネット上の違法・有害情報への対処を目的としたものだ。月間アクティブユーザー数が一定以上の事業者、具体的には「Facebook」「Instagram」などを運営する米Meta、「X」(旧Twitter)を運営するXといった巨大ITプラットフォームの運営企業を対象としている。

誹謗中傷対策として、2022年のプロバイダ責任制限法改正で、匿名で誹謗中傷をされた場合、発信者情報の開示手続を簡易・迅速に行うことができるようになった。今回の改正は、このような開示請求等にとどまらない内容となったため、法律の名称自体が変わることになる。

誹謗中傷が社会問題化しており、その多くがSNSなどのインターネット上で、匿名で投稿されている。誹謗中傷は、ネット上に残り続けることで被害者を傷つけ続けることになる。

一方、誹謗中傷への対応はプラットフォーム側に委ねられている。多くの事業者は、AIと人の目で、誹謗中傷の監視・削除といった対応を行っている。しかし実際は、プラットフォームによっては削除されない、削除申請してもその後通知がこないなどの課題も指摘される。

総務省は2022年4月、「誹謗中傷への取組の透明性・アカウンタビリティ確保状況について」で、ヤフー(現LINEヤフー)、LINE(同)、Google、Meta、Twitter(現X)のプラットフォーム5社の誹謗中傷への対応状況などについて聞き取り、公開している。事業者ごとに、削除申請件数や対応件数に大きなばらつきがあることがわかる。

総務省の「令和4年度インターネット上の違法・有害情報対応相談業務等請負業務報告書」によると、違法・有害情報相談センターに寄せられている相談件数は高止まりしている。その多くは名誉毀損やプライバシー侵害など誹謗中傷に該当するものであり、削除方法を求める相談が多くを占める。つまり、ユーザーが誹謗中傷の削除方法がわからずに困っているという実態があり、それが今回の改正につながったということだ。

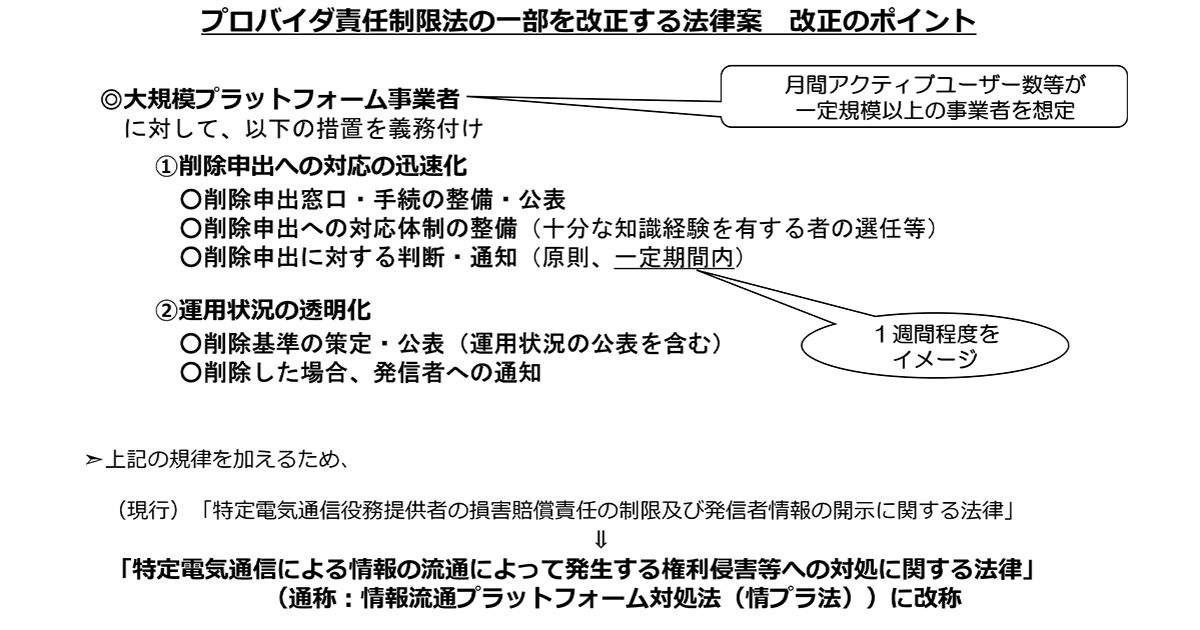

今回の改正で事業者に対し義務付けることは、主に以下の2つ。(1)削除申出への対応の迅速化、(2)運用状況の透明化――となる。

具体的には、削除申出窓口や手続を整備、公表。削除申出への対応体制の整備。削除申出に対して、削除に応じるか否か一週間程度で判断、通知する必要がある。さらに削除基準を策定、公表した上で、削除した場合は発信者への通知も行うこととする。事業者は、削除の実施状況とそれに対する自己評価を年1回公表する必要がある。

違反した場合、総務省は是正勧告や命令を出すことができ、命令に応じない場合は1億円以下の罰金が科される。総務省は今後、施行に向けて詳細な運用ルールを含めた省令の検討を進めるという。

自民党による改正概要

自民党による改正概要

欧州連合(EU)は2022年、「デジタルサービス法」(DSA)を定めている。プラットフォーム事業者に対して、ネット上の違法・有害情報の削除を義務付けるものだ。一方、日本では表現の自由への兼ね合いから、対処が進んでこなかったという経緯がある。

誹謗中傷対策は徐々に進みつつある。ネット上の誹謗中傷が問われることが多い罪「侮辱罪」が厳罰化され、プロバイダ責任制限法改正によって開示請求がスピーディになり、さらに今回の改正で事業者に対して迅速な削除を義務付けることになる。今回の改正によって誹謗中傷削除が大きく前進することを期待したい。

高橋暁子

ITジャーナリスト、成蹊大学客員教授。SNS、10代のネット利用、情報モラルリテラシーが専門。スマホやインターネット関連の事件やトラブル、ICT教育に詳しい。執筆・講演・メディア出演・監修などを手掛ける。教育出版中学国語教科書にコラム 掲載中。元小学校教員。

公式サイト:https://www.akiakatsuki.com/

Twitter:@akiakatsuki

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する