自律システムの革命が始まりつつある中、ある1つの事実がこの半世紀ずっと根強く存在している。ロボットの操作は悩みの種だということだ。だが仮想現実(VR)がその事実を覆す鍵となり、人間と機械の両方にとって新たな領域を切り開く可能性があることが明らかになった。

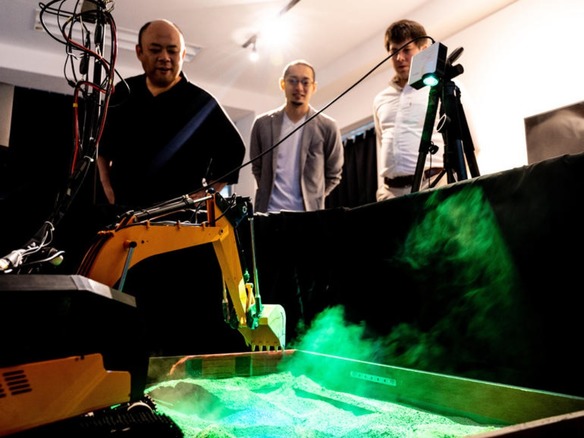

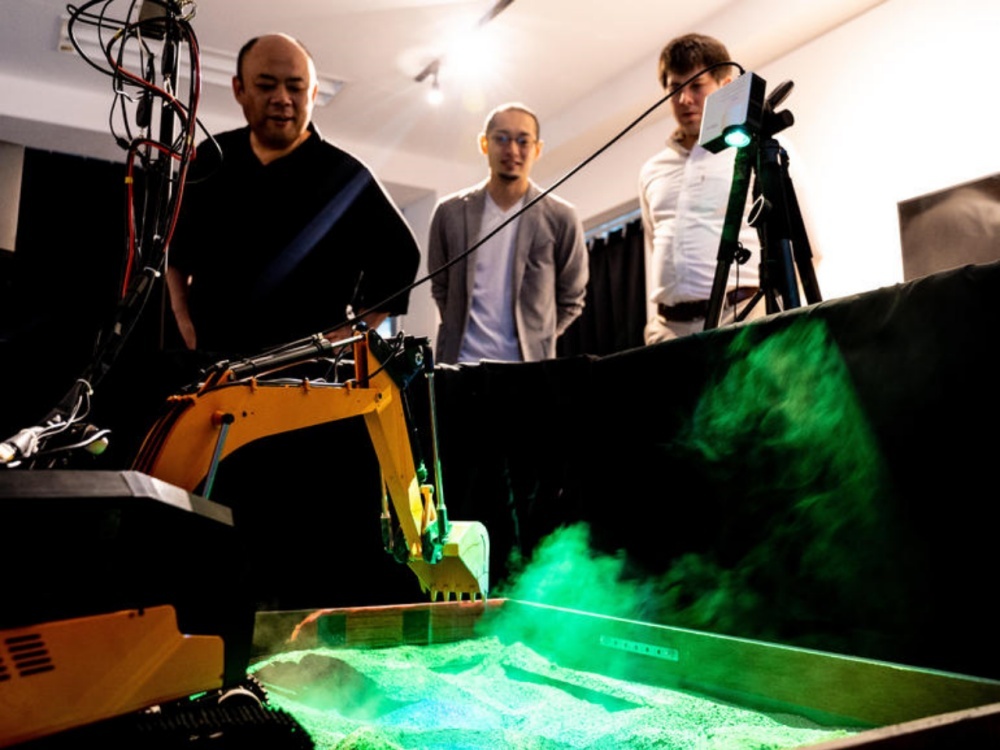

ロボット用ソフトウェアを提供するエスイーフォー(SE4)はこのたび、建設現場や災害復旧での利用が増大しているロボットを遠隔操作するための有望な新しい技術を披露した。この技術を利用した今後の大規模なユースケースの1つは、宇宙で行われる可能性がある。ロボットが間もなく宇宙を開拓し、人間の定住に先立って他の惑星に建物を建設することさえ考えられる。

だがひとまずロボットの操作が悩みの種である点に話を戻そう。ロボティクスのヒューマンマシンインターフェース(HMI)に取り組む人々は、最優先の目標に向けて足並みを揃えている。その目標とは、ユーザーがデバイスの機能性を制限することなく、複雑なロボットをできるだけシンプルで分かりやすい方法で操作できるようにすることだ。つまり、これまで以上に多くのユーザーが、ロボット工学の博士号を取得しなくても複雑なロボットを活用できるようにしたいということだ。

つい最近まで、エンドユーザーらは実際にプログラミング言語を使ってロボットをプログラミングする必要があった。この方法には明らかにマイナス面がある。すなわち、自分の仕事に使うためにロボットを購入した人がおそらく初めからプログラミング言語を知らないということだ。

ごく最近、大きな進歩によりそのマイナス面が改善されている。多くの産業ロボットが、コマンドが視覚的に重なるブロックベースのプログラミング言語を使ってタブレットでプログラムできるようになっている。また、Programming by Demonstration(PbD:デモンストレーションによるプログラミング)と呼ばれる、ユーザーが自分の体を使い、タスクを実行する際の動作に合わせてロボットを物理的に動かす機能もある。

VRによって、ロボットの操作方法は決定的な進化を遂げている。プレーヤーがVRでアバターを動かしてタスクを実行する方法は分かりやすい。ではそのアバターが実世界の物理的なロボットを表すとしたらどうだろうか。ユーザーはどのように体を動かせばバーチャルなタスクを実行できるかを自然と理解している。VRシステムは、とらえた動きをコマンドに変換する。ビデオゲームでは単にコマンドがアバターを動かすが、ロボティクス操作の新たな領域ではコマンドがロボット操作のためにコード化される。

SE4の技術は、オペレーターをバーチャル上でパイロット席に送り込み、その場にロボットを同乗させることができる。単にドローンやRCカーと同じようにロボットを遠隔操作するのではなく、この技術はユーザーがバーチャルに複雑なタスクを実行できるようにする。このシステムの人工知能(AI)は行われている動作だけでなく、その目的も理解する。ユーザーは基本的にロボットにしてほしいことを実行する。するとシステムのAIが最終目標から最初の段階へ逆方向に考え、ロボットに送信される具体的な指示を展開する。

素晴らしい利点が1つある。指示は段階ごとではなく一括で送信されるので、この方法では多くのケースで遅延が問題にならない。地球から送信される指示が火星や宇宙の他の場所へ到達するのに何分もかかることを考慮すると、これは機械を未開の地へ送る計画において考慮すべき重要な点となる。

SE4のVR操作による方法ではさらに、1人のユーザーが1度の処理で複数のロボットを動かすことができる。これは建設など地上における多くの状況で非常に有益で、ロボットの協同が可能になることにより機能性が著しく拡張される。

SE4の取り組みは、VRがいかにオートメーションの力を解放するのに役立つかを示す最新の例だ。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

プライバシーを守って空間を変える

プライバシーを守って空間を変える

ドコモビジネス×海外発スタートアップ

共創で生まれた“使える”人流解析とは

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する