生成型の人工知能(AI)によって、人間が実際に撮影したかのようなリアルな画像が作成可能になり、何が本物で何がAIで生成したものかが判別しにくくなっている。Metaはこの状況を受け、偽情報に対抗するために、AI生成画像に関するいくつかの取り組みを発表した。

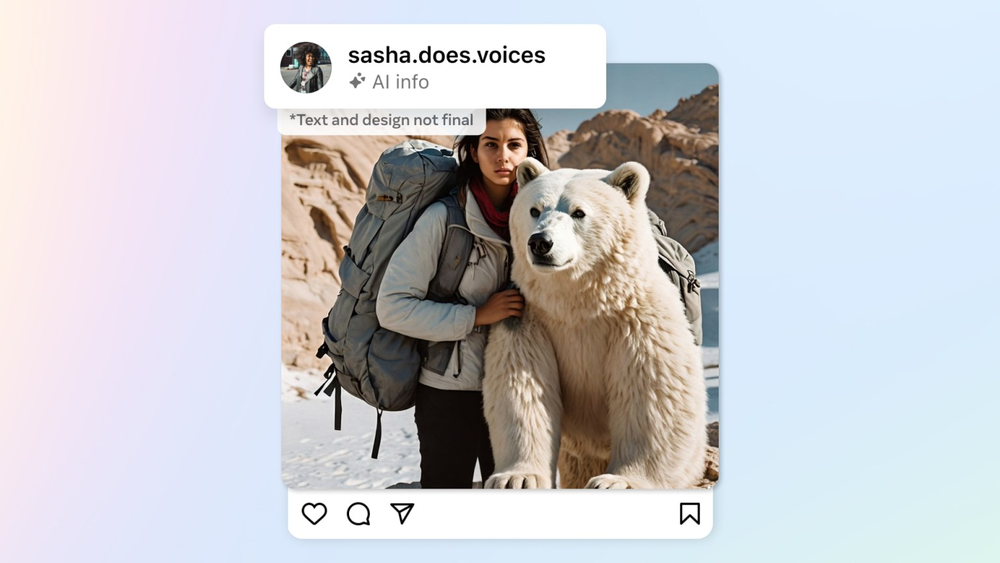

同社は米国時間2月6日、今後数カ月以内に、「Instagram」「Facebook」「Threads」に対して、画像がAIによって生成されたことを表示する新たなラベルを追加すると発表した。

Metaは現在、業界のパートナーと協力して、AIで生成されたコンテンツを検出するための共通の技術標準を策定する取り組みを進めている。また同社の各プラットフォームそれらが検出された場合に、AIで生成されたことを示すラベルを表示する機能を開発している。ラベルは、各プラットフォームが対応するすべての言語で表示できるようにするという。

このラベルは、2023年9月に「TikTok」に搭載された、AIで生成された本物らしく見える画像や音声、動画に付けられるAI生成コンテンツラベルと似たような役割を果たす。

Metaはすでに、「Meta AI」を使用して生成されたすべての画像に、目に見えるマーク、不可視の電子透かし、IPTCのメタデータを埋め込んでいる。これらの画像には、「Imagined with AI」というラベルを付け、人工的に作成されたものであることを表示している。

もちろんこの仕組みは、悪意のあるアクターであれば利用できる抜け穴がある。もしAI画像生成ツールにメタデータを追加するということに従わない会社があれば、Metaがその画像にラベルを付けることはできない。とはいえ、これは正しい方向への一歩ではある。

さまざまな企業がAI生成画像に何らかのシグナルを埋め込む取り組みをしている一方で、動画や音声に関してはまだ対策が進んでいない。一方Metaは、ユーザーが動画や音声を生成する際にAIを使用したことを自ら開示して、Metaが適切なラベルを付けられるようにする機能を追加する。

Metaは、この自発的な開示をユーザーに義務づけ、開示を怠った場合にはペナルティを適用する可能性があるという。また、特に一般大衆が騙されるリスクが高い画像、音声、動画に対しては、目立つラベルを追加する機能も用意する。

これらのツールが開発された背景には、米国などで選挙が目前に迫っている重要な時期に差し掛かっていることがあるとみられる。

この記事は海外Red Ventures発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

無限に広がる可能性

無限に広がる可能性

すべての業務を革新する

NPUを搭載したレノボAIパソコンの実力

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する