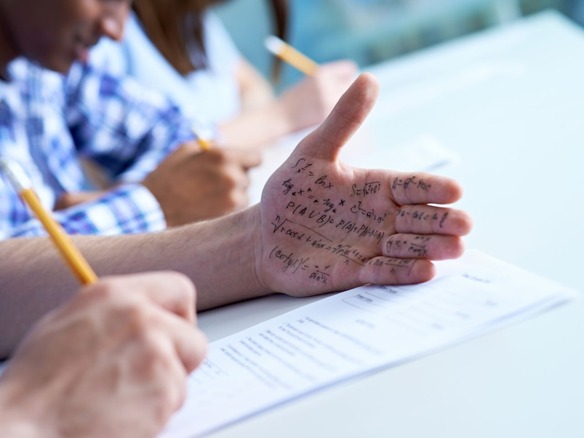

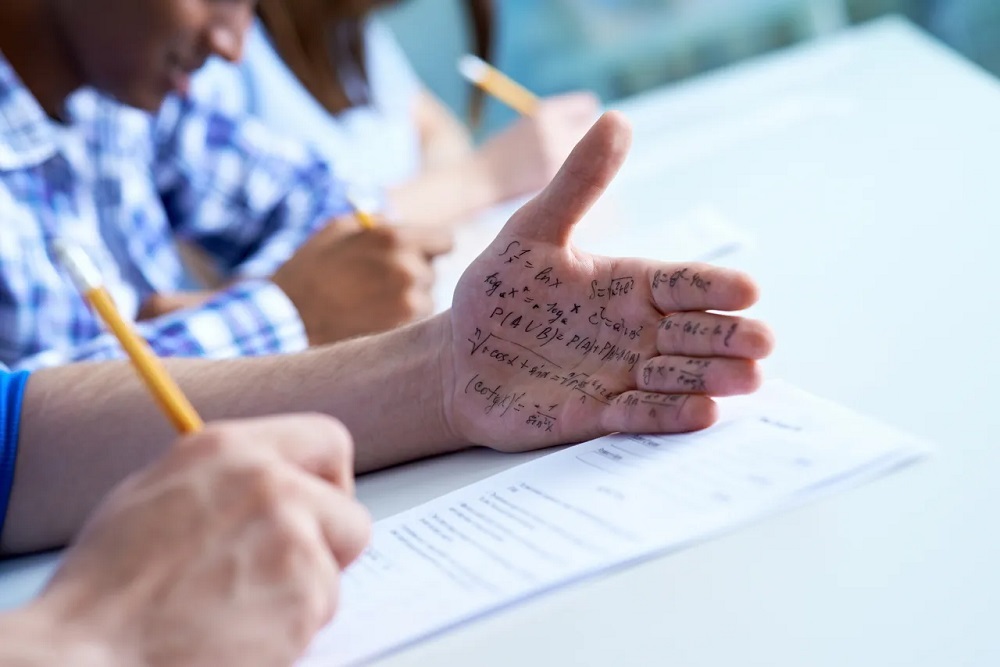

生成人工知能(AI)ツールの台頭によって将来の教育システムの完全性が失われることを、多くの人が懸念している。例えば、数学や論文作成やコーディングで「ChatGPT」のような無料ツールの助けを得られるなら、学生があらゆる課題でそうしたツールを使って不正を働くのを阻止する方法はあるだろうか。スタンフォード大学は、この問題について調査した同大学の研究者の話をインタビュー形式で公開した。

スタンフォード大学の教育学者Victor Lee氏とDenise Pope氏によれば、学生による不正行為と利用できるテクノロジーの間には、ほとんど関連性がないことが分かったという。

Pope氏は次のように述べている。「AIのおかげで学生が不正を働きやすくなり、不正が行われる確率が高まっていると盛んに報じられている」「だが、私たちのデータでは、今のところそのような兆候は見られない」

ChatGPTや類似のAIテクノロジーが登場するはるか以前から、不正行為の多さは教育システムを悩ませてきた。Pope氏によれば、学生の60~70%が、過去1カ月間に少なくとも一度は「不正」を働いたと報告していたという。

ただし、2023年の調査では、この割合は以前と同じかわずかに減少していた。ChatGPTなどの新しいテクノロジーに特化した質問や、ChatGPTを学校からの課題にどのように利用しているかといった質問が追加されていたにもかかわらずだ。

学生がこの調査に正直に回答したのか疑う人もいるかもしれないが、両氏によれば、この調査は匿名で行われたうえ、「不正行為を働いていますか」などと直接的に尋ねるのではなく、不正とみなされるさまざまな行為について具体的に尋ねたため、学生はおおむね正直に回答したという。

「現時点で言える最も確実なことは、多くの人にとって驚きかもしれないが、データが示しているとおり、不正行為の頻度はAIのせいで高まってなどいないということだ」と、Lee氏は語った。

この記事は海外Red Ventures発の記事を朝日インタラクティブが日本向けに編集したものです。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

ひとごとではない生成AIの衝撃

ひとごとではない生成AIの衝撃

Copilot + PCならではのAI機能にくわえ

HP独自のAI機能がPCに変革をもたらす

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する