Googleは、物をつかむ機能を備えるロボットに深層畳み込みニューラルネットワーク(Convolutional Neural Network:CNN)を応用し、上手なつかみ方を自律的に学習していく実験を実施した。人間が介在せずロボットに試行錯誤させることで、当初34%あった失敗率を18%まで“ロボット自ら”下げることができた。

ロボットの性能は以前と比べ飛躍的に進歩しているが、センサとモーターを組み合わせて物をつかむ簡単な動作でさえ、人間の技能レベルにはまだまだ到達できないという。このレベル差を縮める手法として、Googleはフィードバックと制御を連続的に実行させ、それを機械学習と連携させる取り組みを試験した。

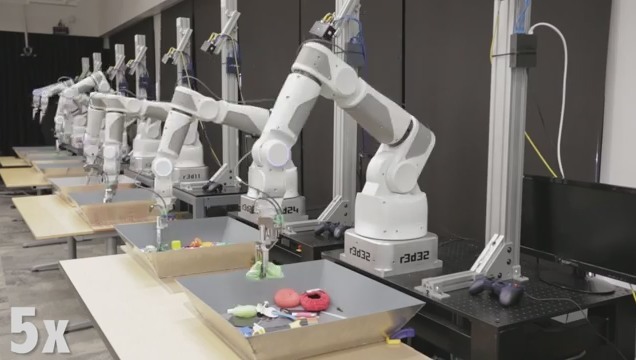

Googleは、カメラの画像データを見て物をつかむようにプログラムしたロボットを用意し、つかむことに失敗しても人間が動作を正すのではなく、試行結果に応じて動きを自動修正するよう設定した。さらに、複数のロボットに同様の取り組みを実行させ、学習結果を相互に交換できるようにしておいた。

“練習”を始めたロボットたち(出典:Google)

実験を始めたばかりの段階では失敗ばかりしてうまく物をつかめなかったが、“練習”を続けるに従い「手と目の連携」が進み、成功率が上昇したそうだ。

つかみ方に“工夫”が見られるようになってきた(出典:Google)

約3000時間の練習をさせ、試行回数が80万回を超えた段階で、「知性的な受動的行動の芽生えが見られた」としている。そして、失敗率を34%から18%まで下げられた。

初期のつかみ方が下手だった状態(出典:Google)

上達したロボット(出典:Google)

Googleは、機械学習(マシンラーニング)システム用ツールキット「TensorFlow」を通じて深層学習(ディープラーニング)の研究に取り組み、画像やテキスト、音声の自動認識といった分野でさまざまな成果を上げてきた。機械の自動制御は難易度が高いものの、大規模な機械学習をロボット制御に適用できれば、ロボットおよび自動制御の根本的な問題解決に1歩近づけると見込む。

なお、マサチューセッツ工科大学(MIT)もロボットの相互学習技術に注目している。2016年版の革新技術リスト「10 Breakthrough Technologies 2016」で取り上げ、3年から5年後に実用化されると予想した。

CNET Japanの記事を毎朝メールでまとめ読み(無料)

CNET Japan Live 2025開催レポート

CNET Japan Live 2025開催レポート

イノベーションの「種」から社会実装へ--

社会課題の解決に挑む各社の挑戦

心と体をたった1分で見える化

心と体をたった1分で見える化

働くあなたの心身コンディションを見守る

最新スマートウオッチが整える日常へ

無限に広がる可能性

無限に広がる可能性

すべての業務を革新する

NPUを搭載したレノボAIパソコンの実力

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

メルカリが「2四半期連続のMAU減少」を恐れない理由--日本事業責任者が語る【インタビュー】

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

なぜPayPayは他のスマホ決済を圧倒できたのか--「やり方はADSLの時と同じ」とは

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

AIが通訳するから英語学習は今後「オワコン」?--スピークバディCEOの見方は

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

パラマウントベッド、100人の若手が浮き彫りにした課題からCVCが誕生

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

野村不動産グループが浜松町に本社を「移転する前」に実施した「トライアルオフィス」とは

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「ChatGPT Search」の衝撃--Chromeの検索窓がデフォルトで「ChatGPT」に

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

「S.RIDE」が目指す「タクシーが捕まる世界」--タクシー配車のエスライド、ビジネス向け好調

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

物流の現場でデータドリブンな文化を創る--「2024年問題」に向け、大和物流が挑む効率化とは

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

「ビットコイン」に資産性はあるのか--積立サービスを始めたメルカリ、担当CEOに聞いた

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

培養肉の課題は多大なコスト--うなぎ開発のForsea Foodsに聞く商品化までの道のり

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

過去の歴史から学ぶ持続可能な事業とは--陽と人と日本郵政グループ、農業と物流の課題解決へ

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

通信品質対策にHAPS、銀行にdポイント--6月就任のNTTドコモ新社長、前田氏に聞く

「代理店でもコンサルでもない」I&COが企業の課題を解決する

「代理店でもコンサルでもない」I&COが企業の課題を解決する